自动化工具 openclaw 帮我做 cicd,性能自动化,接口自动化

一、背景

忙里偷跑闲,花 2 天时间安装了 openclaw,试着帮我做做测试的工作,免费的 24 小时员工:

目标:

- cicd

- 性能自动化

- 接口自动化

二、openclaw 安装比较简单:

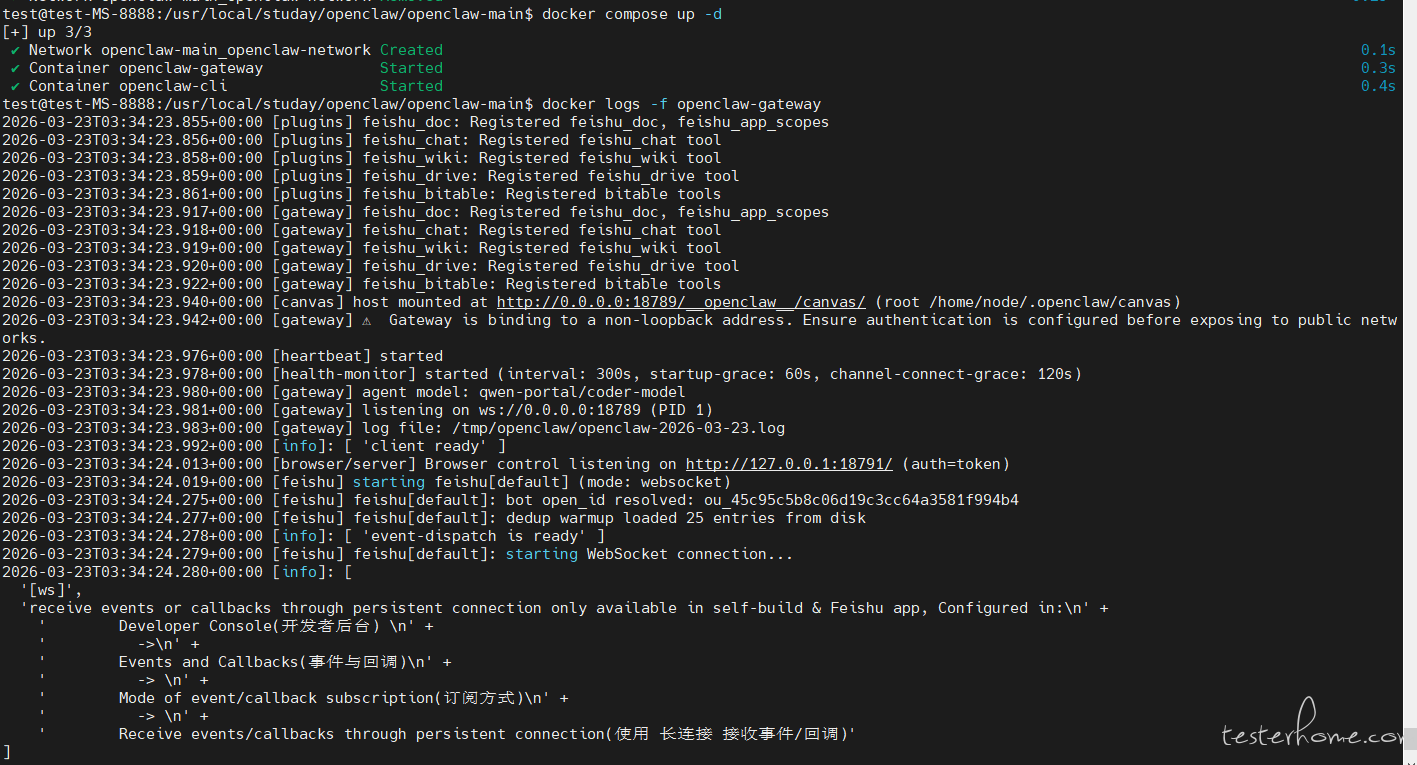

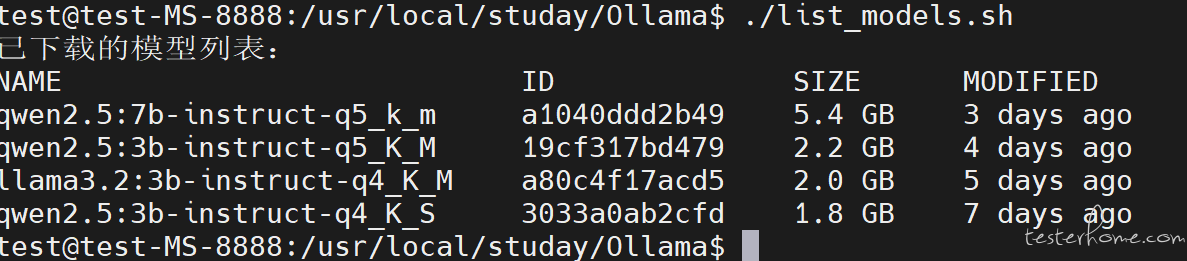

docker(openclaw-cli+openclaw-gateway)+ ollama + 飞书 (略)

用 docker 的好处是移植方便只搭好一次,到那都可用,太香了

三、确定是否安装完毕

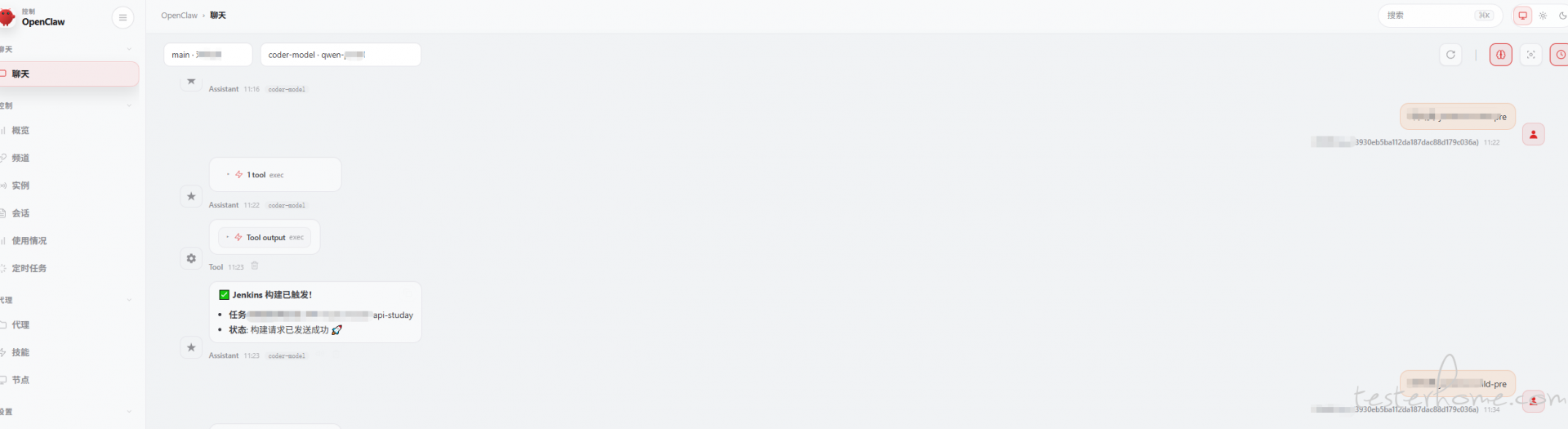

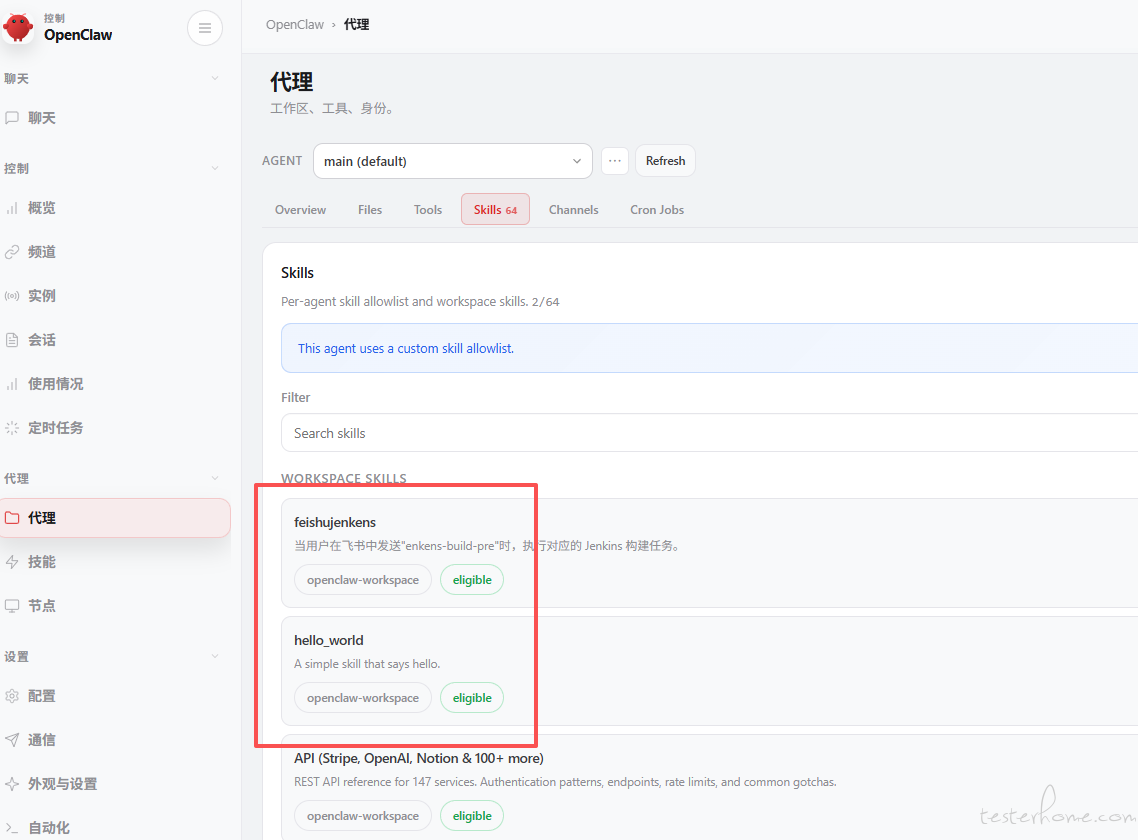

1. 控制 UI

1.1 控制 UI

1.2 加载技能

2. 运行 cicd

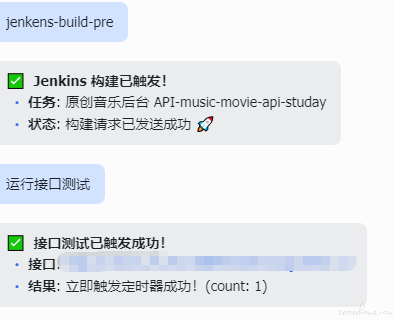

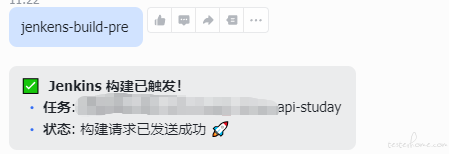

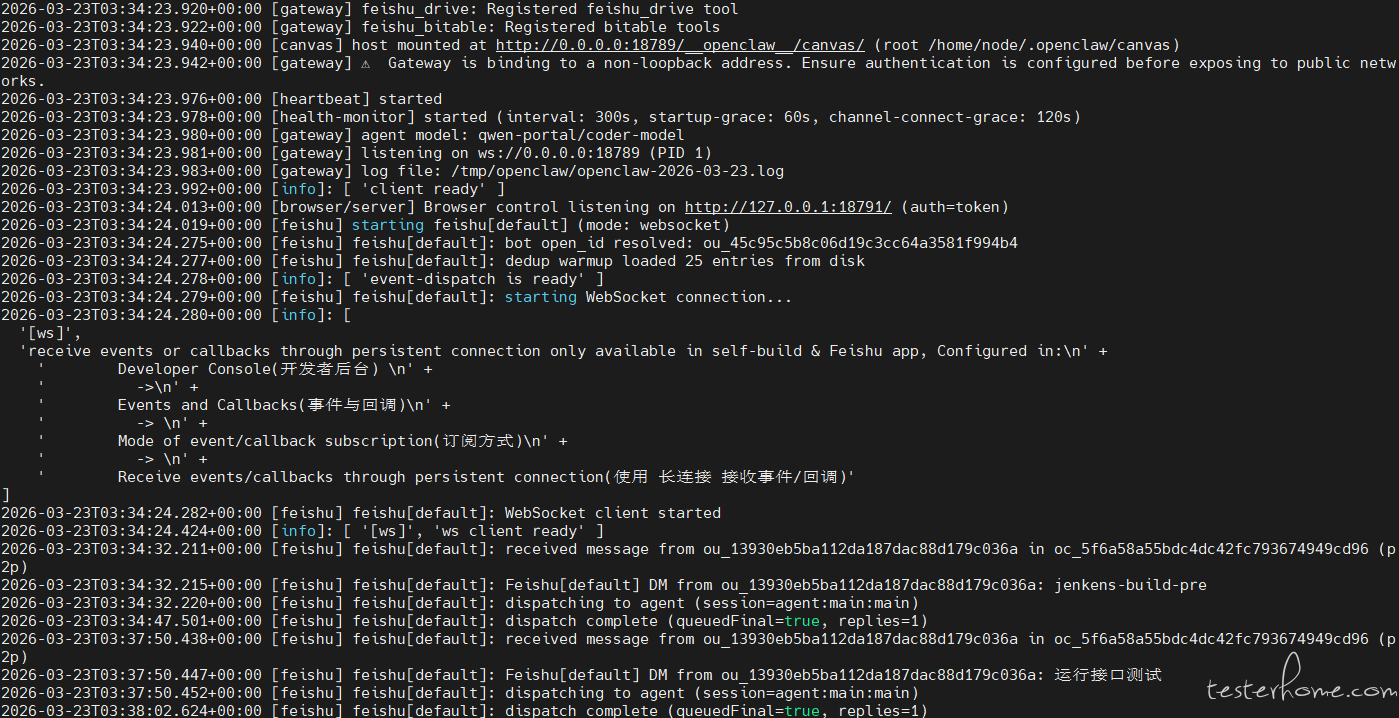

2.1 飞书输入提示试

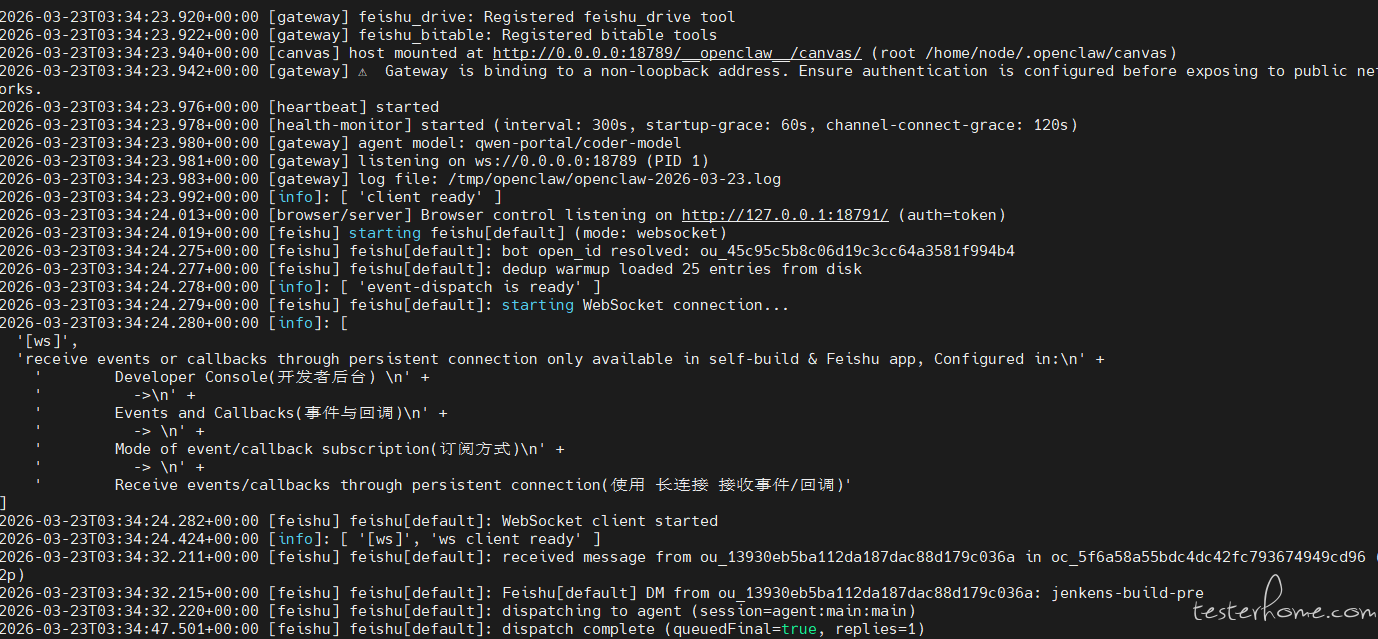

2.2 gateway 日志

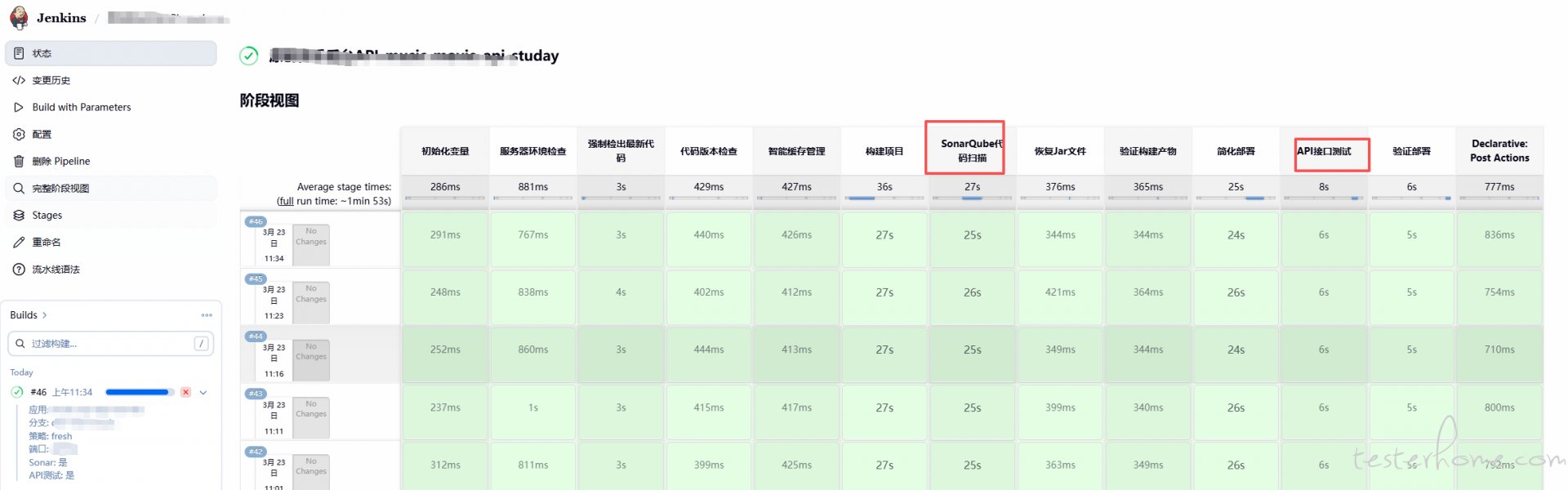

2.3 确认 cicd 已运行

2.4 确认运行 sonarqub

2.5 确认运行性能测试

2.6 监控平台

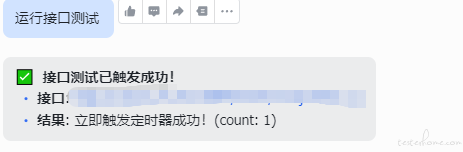

3. 运行接口测试

四、openclaw 问题思考

4.1 现在依赖于以前的接口平台、性能平台,cicd,监控平台都以搭建好后,就可以 24 小时直接调用

4.2 测试人员只须专注入编写技能与工具即可

4.3 openclaw 也可以根据需求生成用例,有现有技能还没有测试,应该可以与 dify 平台要进行一下对比

4.4 可以用免费的 ollama 对于直接调用任务是可以的,有钱可以买大模型的 tokens

4.5 ai 变化太快,不同的大模型及 agent 出来,测试压力很大

@294332968@qq.com 目前找工作中,北京有测试机会记得 callme

「原创声明:保留所有权利,禁止转载」