AI测试 AI 驱动的 UI 自动化测试:国产龙虾 workbuddy 网页识别效果不理想,大神们有啥好的方法吗?

各位大神,

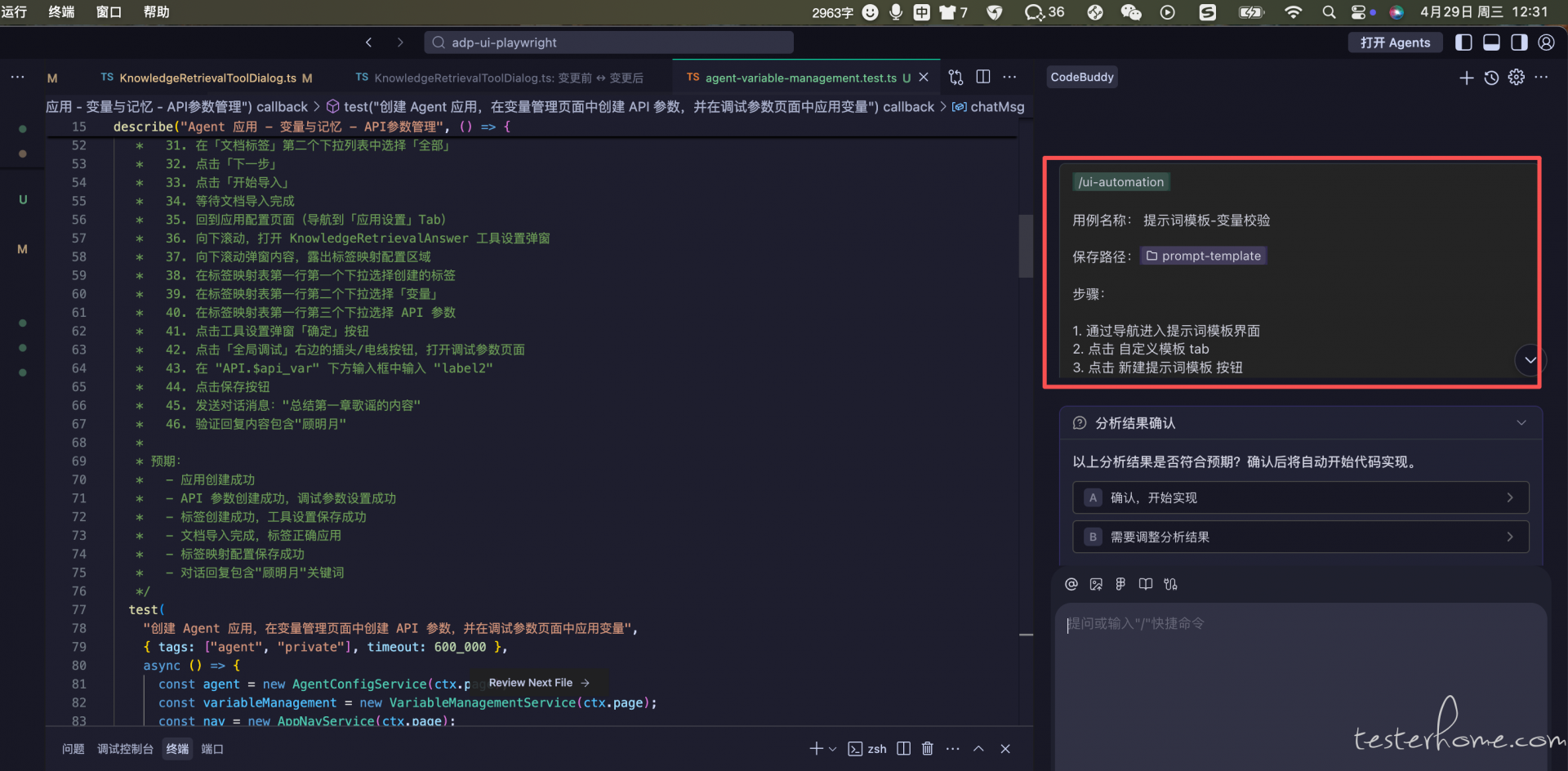

目前我在使用国产龙虾 workbuddy 做我们系统的 UI 自动化测试,但目前效果不理想,对网页的识别不是很好。

提示词:

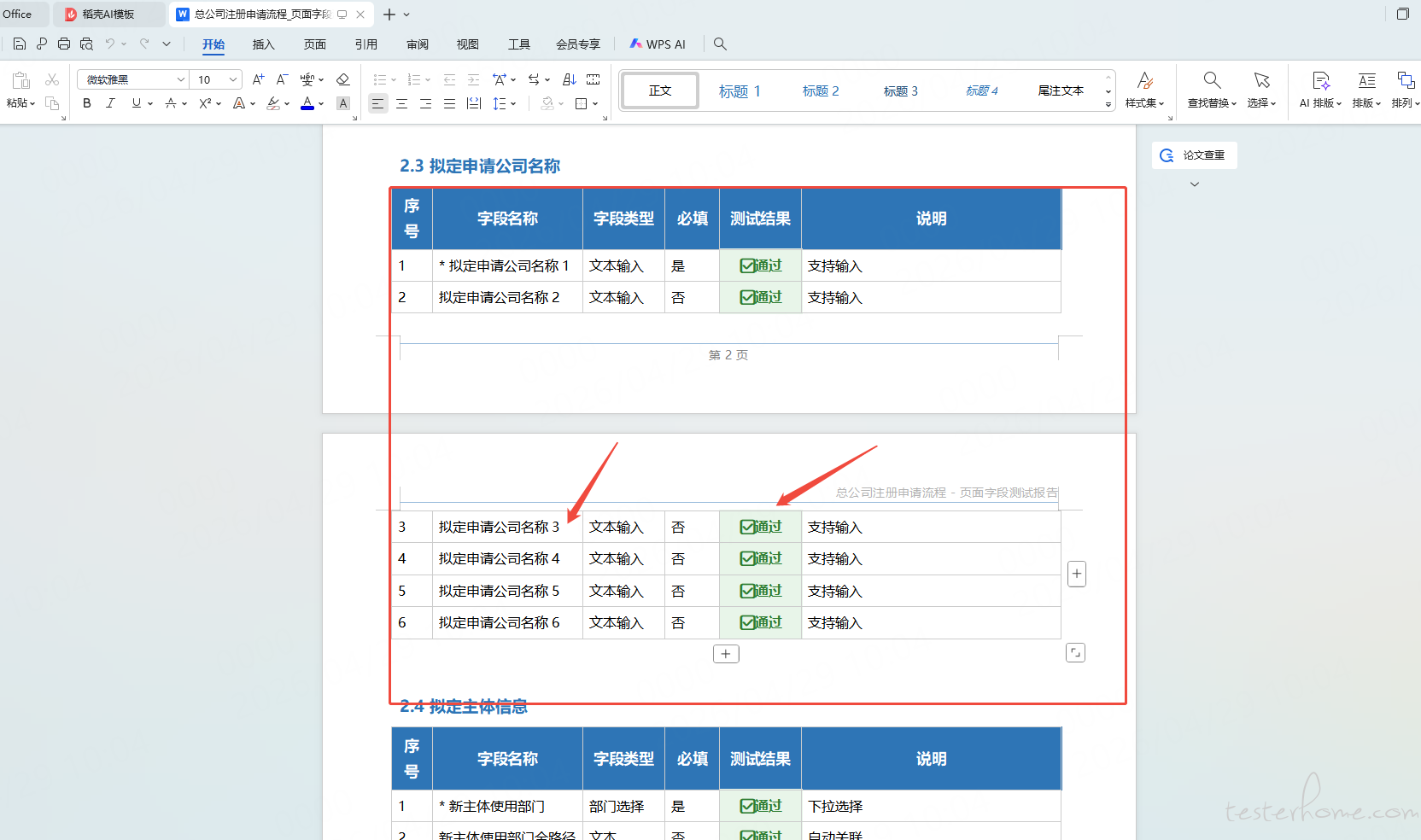

你是一位资深测试工程师,根据此上传需求文档(文档中对字段值要求的详细描述),运用各种测试方法,生成针对页面字段测试的测试用例,根据生成的测试用例对 XX 流程发起页面所有的字段进行测试,重要步骤和缺陷都需要截图,请按以下操作步骤进入流程发起页面 1、浏览器访问http://11.9.67.99:8888/XXX 2、输入用户名:张三, 密码:123456, 点击登录,登录成功 2、左侧导航栏,点击【办公】,在办公页面的搜索框中输入流程名称,在搜索结果列表中选择流程,打开流程发起列表页面 3、页面右上角,点击【新建】按钮,浏览器打开新页签,此页签为流程的发起页面,以上所有测试执行完成后,生成一份详细的测试报告

发现的问题:我发现通过上面的提示词执行完后,测试报告是生成了,报告中生成的字段的用例都是通过的状态,我实际去看这是一个伪报告,AI 没有去真正识别页面的元素,导致 AI 没有测试执行就生成报告了。

各位大神,想确认两个问题:

1、大家在做 UI 自动化测试的时候,对于 AI 对网页识别效果不好,有什么心得体会,都会用什么 skill 提升识别的准确度

2、对于这种自动化的全流程测试,需求分析 - 测试用例自动生成 - 用例自动执行 - 生成测试报告,有什么成功的经验分享吗?

非常感谢,各位大神。