开发者朋友们大家好:

这里是 「RTE 开发者日报」 ,每天和大家一起看新闻、聊八卦。我们的社区编辑团队会整理分享 RTE(Real-Time Engagement)领域内「有话题的 技术 」、「有亮点的 产品 」、「有思考的 文章 」、「有态度的 观点 」、「有看点的 活动 」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@ 赵怡岭、@ 鲍勃

01 有话题的技术

1、MiniMax 开启五天的开源周:首发推理大模型 MiniMax-M1

MiniMax 开启五天的开源周。

第一天隆重推出 MiniMax-M1——全球首个开放权重、基于混合注意力推理架构的大规模模型。该模型采用混合专家系统(MoE)与 Lightning Attention 相结合的创新设计,其研发基于前代产品 MiniMax-Text-01 的架构基础,总参数量达 4560 亿,其中每 token 激活参数为 459 亿。

Lightning Attention 把注意力计算分成块内和块间两部分,块内用传统注意力计算,块间用线性注意力的核技巧,避免了累积求和操作(cumsum)拖慢速度。

Lightning Attention 还采用了分块技术(tiling)充分利用 GPU 硬件,让内存使用更高效,训练速度不随序列长度增加而变慢。

与 MiniMax-Text-01 保持一致的是,M1 模型原生支持 100 万 token 的上下文长度,达到 DeepSeek R1 上下文容量的 8 倍。其闪电注意力机制显著提升了推理时的计算效率:例如在生成 10 万 token 文本时,M1 的浮点运算量仅为 DeepSeek R1 的 25%。这些特性使 M1 特别适合需要处理长文本输入与深度思考的复杂任务。训练成本仅为 53.47 万美元。

目前,MiniMax-M1 已经集成到了 MiniMax Chat 中。

HuggingFace: https://huggingface.co/collections/MiniMaxAI/minimax-m1-68502ad9634ec0eeac8cf094

GitHub: https://github.com/MiniMax-AI/MiniMax-M1

技术报告:https://github.com/MiniMax-AI/MiniMax-M1/blob/main/MiniMax_M1_tech_report.pdf(@AI 小小将、@MiniMax__AI\@X、@ 量子位)

2、腾讯混元 3D 2.1 大模型对外全链路开源,适配消费级显卡,个人电脑即可运行

在 CVPR 2025(计算机视觉领域顶会之一)上,腾讯混元 3D 2.1 大模型对外全链路开源——模型权重及架构、训练代码、数据处理流程等等,全部开放。这是首个全链路开源的工业级 3D 生成大模型,支持从几何建模到材质渲染的全流程 AI 生成,并适配消费级显卡,个人电脑即可运行。

本次开源的混元 3D 2.1 大模型在 3D 生成的纹理质感和光影表现方面大幅提升,让 AI 3D 建模摆脱「塑料感」,在需要逼真建模的游戏、动画等领域,更加实用。

这次开源的混元 3D 2.1 模型,在多个关键能力上实现了新升级——

支持 PBR 材质贴图:引入 PBR(基于物理的渲染)技术,能让模型彻底告别「塑料感」。生成的金属,有光泽、有冷硬感;生成的木头,有纹理、磨砂感;陶瓷,还能反光。哪怕换个角度和光照环境,质感依然在线。用户盲测中,质感胜出率达 78%;

几何建模更精细:采用 DiT 几何架构(一种让 3D 模型从轮廓到细节都更精细的生成方式),生成的 3D 效果不只是好看,还结构清晰、边缘干净、不歪不塌,哪怕你后面要贴材质、做动画,甚至拿去 3D 打印,都非常合适;

输出标准化、可即用:模型生成结果支持标准格式,可以直接拖进 Unreal、Unity、Blender 等主流 3D 工具里,马上就能用,不需要额外转格式。

开源主页:https://3d-models.hunyuan.tencent.com/

HuggingFace 模型库:https://huggingface.co/tencent/Hunyuan3D-2.1

Github:https://github.com/Tencent-Hunyuan/Hunyuan3D-2.1

混元 3D AI 创作引擎:https://3d.hunyuan.tencent.com/(@ 腾讯、@ 腾讯混元)

3、Deepgram 推出 Voice Agent API,VAQI 综合评分第一,每小时 4.50 美元

Deepgram 发布了 Voice Agent API,一款为企业级应用打造的、具备实时性和高性价比的对话式 AI API。

该 API 的关键亮点包括:

统一集成: 集成了 STT、LLM 编排和 TTS 功能,允许开发者选择使用 Deepgram 提供的模型,或者集成自己的模型(BYO models)。

模型级别控制: 支持插话、轮流发言以及会话中期的参数调整,从而确保对话的流畅性和自然性。

透明与控制: 彻底消除了「黑箱」问题,开发者可以完全掌控编排、部署以及模型本身,实现高度的可见性和控制力。

生产就绪规模: 具备大规模扩展能力,完美适用于企业级应用场景。

相关链接:https://deepgram.com/learn/deepgram-launches-voice-agent-api(@DeepgramAI\@X)

4、视频虚拟试衣模型 MagicTryOn:支持图像试穿、视频试穿,以及自定义试穿

浙大、vivo 最新出的一款视频虚拟试衣模型:MagicTryOn,服装的时空一致性、稳定性、服装细节都达到了很好的效果,其效果图可以直接用于电商广告了。该模型支持图像试穿、视频试穿,以及自定义试穿,并且擅长在比如跳舞这种人体大幅度运动,以及复杂场景中试穿。

同时该模型具备泛化能力,支持在玩偶上进行虚拟试衣。

另外,该模型其用扩散 Transformer 取代 U-Net 架构,来提升模型的表达能力;结合全自注意力机制联合建模视频的时空一致性,确保试衣效果在时间和空间维度上自然流畅。(@aigclink\@X)

5、月之暗面发布开源编程大模型 Kimi-Dev-72B

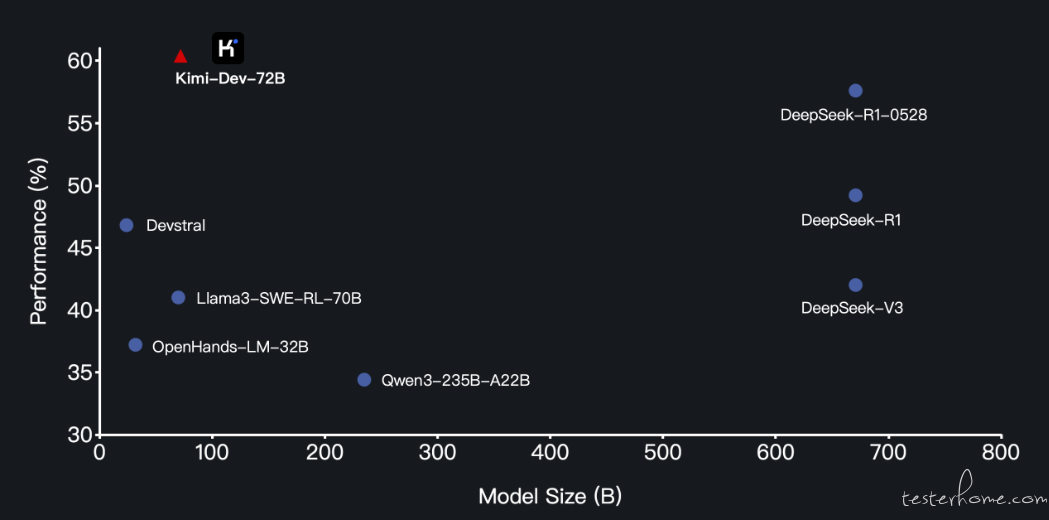

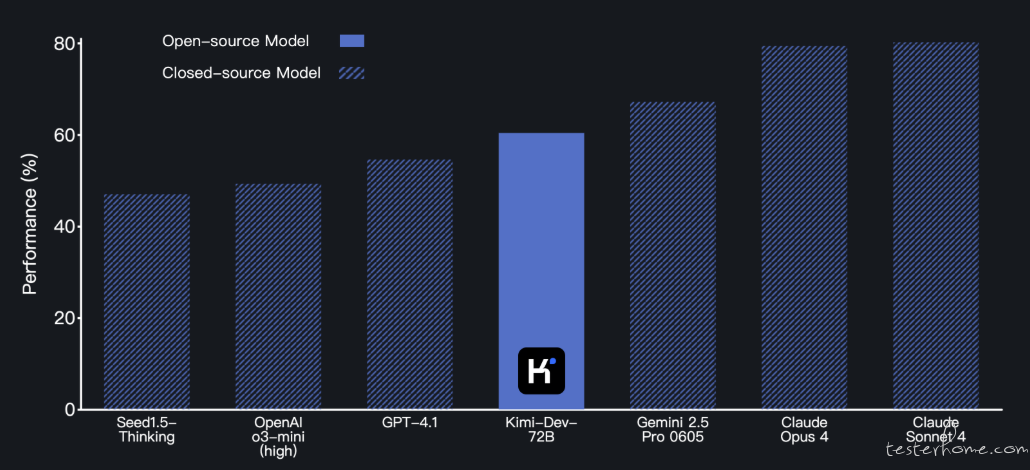

月之暗面发布了开源编程大模型 ——Kimi-Dev-72B。在所有开源模型中,Kimi-Dev-72B 在代码生成评估基准 SWE-bench Verified 中取得了全新的 SOTA 分数。

目前,Kimi-Dev-72B 已向社区开放,以供进一步研发,主要资源包括了模型权重、源代码和技术报告(即将发布)。月之暗面希望开发者和组织能够探索、集成和扩展该模型的应用。

作为一个强大的开源 LLM,Kimi-Dev-72B 具有以下亮点:

Kimi-Dev-72B 在 SWE-bench Verified 上取得了 60.4% 的成绩,在开源模型中创下了新的 SOTA 纪录。

Kimi-Dev-72B 通过大规模强化学习进行优化。它能够自主在 Docker 中修补真实代码仓库,并且只有在整个测试套件通过的情况下才会获得奖励。这确保了其提供的解决方案是正确且稳健的,符合现实世界中的开发标准。

Kimi-Dev-72B 可在 Hugging Face 和 GitHub 上下载和部署。

下图为 SWE-bench Verified 基准上,Kimi-Dev-72B 与其他开源模型的性能比较。

下图为 SWE-bench Verified 基准上,Kimi-Dev-72B 与闭源模型的性能比较。

Hugging Face 地址:https://huggingface.co/moonshotai/Kimi-Dev-72B

GitHub 地址:https://github.com/MoonshotAI/Kimi-Dev

博客地址:https://moonshotai.github.io/Kimi-Dev/(@ 机器之心)

02 有亮点的产品

1、GenSpark 推出 AI 浏览器,能自动浏览网页、整理信息、甚至制作个人播客

GenSpark 推出 AI 浏览器,将 AI 能力融入每个网页,提供比价、帮助选购和视频内容总结等功能。例如在浏览视频时,它还可以帮用户总结内容、提取数据并且生成幻灯片。

其中,「自动驾驶模式」功能可以自动浏览微博、整理信息,甚至制作个人播客。

在演示视频中,用户只需要说一句「根据我的推特时间线制作一个简短播客」,Genspark 就会自动打开新标签页,浏览用户的个人信息流,提取热门话题,然后生成一个定制的播客节目。整个过程完全自动化,用户可以去泡杯咖啡,回来就能听到专属的科技资讯播客。

还能访问用户的付费网站。比如用户订阅了 SimilarWeb 这样的数据分析平台,Genspark 可以自动登录,搜索关心的数据,比较不同产品的市场表现,最后整理成清晰的表格。

而且该浏览器内置 MCP 商店,提供 700 多个工具连接,能够实现自动化工作流,还集成了广告拦截功能,目前仅推出 Mac 版本。(@ 二爷 Hack、@ 腾讯研究院)

2、新一代 Meta AI 智能眼镜将在本周五发布

6 月 16 日晚,美国运动眼镜品牌 Oakley 宣布,与 Meta 合作的新品将在 6 月 20 日发布。

据彭博社此前爆料,本次 Meta 与 Oakley 合作的产品代号为「Supernova 2」,基于 Oakley 的 Sphaera 眼镜型号,旨在开发一款方便运动员使用的智能眼镜。

据悉,「Supernova 2」不带任何显示功能,基本等同于 Ray-Ban Meta 的运动款,对自行车骑行等运动进行了优化,眼镜的摄像头将会被放置在眼镜框中间。(@APPSO)

3、Flowith 移动端引入语音交互 Voice to Agent,随身记录会议和任务

Flowith 在移动端发布了实时语言智能体 Dozer。Dozer 最长支持监听 8 小时并转录音频,然后将音频拆分成任务交给 Neo 进行分析和相关操作。该产品现已在 Flowith iOS 应用上线。

相关链接:https://apps.apple.com/us/app/flowith/id6742640078(@flowith_ai\@X)

03 有态度的观点

1、 Cursor CEO:五年内所有编程将用 AI 进行

日前,AI 编程产品 Cursor 的 CEO Michael Truell 做客 Y Combinator 的播客节目,分享了自己的创业经历,也提出了部分未来发展观点。

Michael 认为,在未来的 5 到 10 年里,有可能发明一种新的方法来构建更高水平、更高效的软件。其强调,大家使用 Cursor 的目标是到达那里。

同时 Michael 也表示,想要实现上述情景的途径是使用 AI 编程,然后不断发展,将其从普通编程发展到看起来非常不同的东西。

同时,Michael 也在对话中表达了自己对 Agent 的看法:其认为 Agent 在达到人类水平方面仍存在许多瓶颈。其中「上下文窗口限制」「持续学习能力弱」「用户交互界面需要革新」都是需要突破的重大瓶颈。

Michael 还表示,未来编程范式转变,而代码将变成可选项,逻辑设计与审美成为核心。其进一步解释表示,人类程序员未来更像是「逻辑设计师」,专注于构建意图而非语法细节。

他还强调,未来开发者的核心竞争力将会是「审美与判断」,其中包括代码结构美感、逻辑合理性、可维护性。Michael 认为,审美与判断是无法被 AI 替代的,并且「真正优秀的工程师不是满足已有标准,而是定义更高的标准。」(@APPSO)

更多 Voice Agent 学习笔记:

实时多模态如何重塑未来交互?我们邀请 Gemini 解锁了 39 个实时互动新可能丨 Voice Agent 学习笔记

级联 vs 端到端、全双工、轮次检测、方言语种、商业模式…语音 AI 开发者都在关心什么?丨 Voice Agent 学习笔记

a16z 最新报告:AI 数字人应用层即将爆发,或将孕育数十亿美金市场丨 Voice Agent 学习笔记

a16z 合伙人:语音交互将成为 AI 应用公司最强大的突破口之一,巨头们在 B2C 市场已落后太多丨 Voice Agent 学习笔记

ElevenLabs 33 亿美元估值的秘密:技术驱动 + 用户导向的「小熊软糖」团队丨 Voice Agent 学习笔记

端侧 AI 时代,每台家居设备都可以是一个 AI Agent 丨 Voice Agent 学习笔记

世界最炙手可热的语音 AI 公司,举办了一场全球黑客松,冠军作品你可能已经看过

对话 TalktoApps 创始人:Voice AI 提高了我五倍的生产力,语音输入是人机交互的未来

写在最后:

我们欢迎更多的小伙伴参与 「RTE 开发者日报」 内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

素材来源官方媒体/网络新闻