开发者朋友们大家好:

这里是 「RTE 开发者日报」 ,每天和大家一起看新闻、聊八卦。我们的社区编辑团队会整理分享 RTE(Real-Time Engagement)领域内「有话题的 技术 」、「有亮点的 产品 」、「有思考的 文章 」、「有态度的观点」、「有看点的 活动 」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@ 赵怡岭、@ 鲍勃

01.有话题的技术

1、KeySync 开源高清口型同步方案,能够无缝处理面部遮挡问题

与现有方法不同,KeySync 能够生成与驱动音频高度对齐的高分辨率口型同步视频,同时最大限度地减少输入视频中的表情泄漏,并能够无缝处理面部遮挡问题。

KeySync 包含两个阶段,这两个阶段都通过潜变量扩散模型生成视频,条件输入为视频和音频,二者的区别在于参考帧的选择。在关键帧生成阶段,模型接收一个身份帧 ,该帧会被重复并与加入噪声的视频输入进行拼接。在插值阶段,模型则以两个连续的关键帧为条件,并引入可学习的中间嵌入向量 。两个阶段都融合了来自 HuBERT 的音频嵌入 。(@ 带你学 AI)

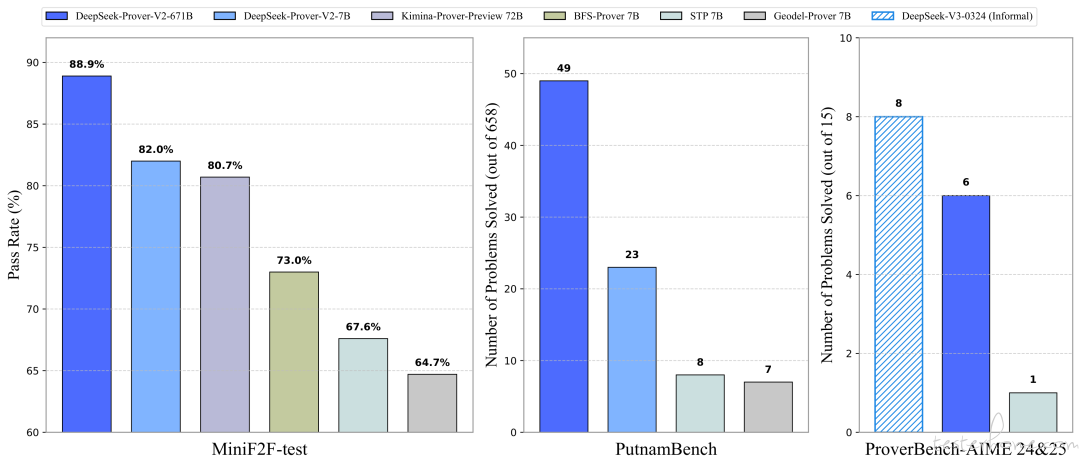

2、DeepSeek-Prover-V2 发布,专精于数学定理证明

在 4 月 30 日晚,机器学习协作平台 HuggingFace 上就更新了 DeepSeek-Prover-V2 的一些技术细节。

这次 DeepSeek 团队发布了两个版本的 DeepSeek-Prover-V2 模型,参数规模分别为 7B 和 671B。

其中,DeepSeek-Prover-V2-671B 是在 DeepSeek-V3-Base 基础上训练而成,而 DeepSeek-Prover-V2-7B 则基于 DeepSeek-Prover-V1.5-Base 构建,并支持最长 32K tokens 的上下文长度扩展。

DeepSeek-Prover-V2-671B 最大可处理 163,840 tokens 的上下文,比 DeepSeek-V3 的 128k 有约 28% 的提升。

该模型基础架构为 Deepseek-V3,拥有 2048 个 MoE 中间层、且每层都是 MoE 层,每个 MoE 层包含 1 个共享专家和 256 个路由专家,每个 token 会激活 8 个专家。(@ 机器之心、@ 机器之心 SOTA 模型)

3、Suno v4.5 升级:多种音乐流派选择,8 分钟长音乐生成

新增功能:

扩展的流派和更智能的混搭:更多流派选择——中西部情绪摇滚 + 新灵魂乐或 EDM+ 民谣等风格无缝融合;

增强的音色:现在的人声更具冲击力——具有更强的深度、情感和范围。从私密的耳语到完全爆发的强力副歌,v4.5 都能充满感情地呈现;

更复杂、更富质感的声音:v4.5 能够捕捉到使您的音乐更加出色的微妙之处,包括层次分明的乐器、音调变化以及具有深度的声音细节。诸如「树叶纹理」或「旋律口哨声」之类的提示现在能够清晰且立体地呈现;

更好的提示遵循度:情绪、氛围、乐器和细节都能精确捕捉,因此想象的就是听到的;

提示增强助手:放入一些标签或粗略的想法,点击「增强」,即可获得丰富且完全成型的风格提示,您可以直接使用或进行混音;

升级的封面 + 角色:封面保留了更多旋律细节。流派切换感觉无缝衔接;

封面 + 角色可以结合使用:一次性混音声音、结构和风格;

扩展的歌曲长度:之前为 4 分钟,现在无需使用 Extend 即可创作长达 8 分钟的歌曲;

改进的音频:更饱满、更平衡的混音。(@Suno@X)

4、英伟达开源 Parakeet TDT 0.6B——Open ASR 排行榜上最好的语音识别模型

英伟达出了一个 ASR,叫 Parakeet TDT 0.6B V2,目前只支持英文,发布之后,直接冲到了 HF ASR Leaderboard 第一位。

亮点:

自动加标点与大小写;

精准的逐词时间戳;

支持最长 20 分钟音频转写;

强悍处理 数字口播 与 歌词识别。

https://huggingface.co/spaces/nvidia/parakeet-tdt-0.6b-v2

(@ EC Elliot@X、@Vaibhav (VB) Srivastav@X)

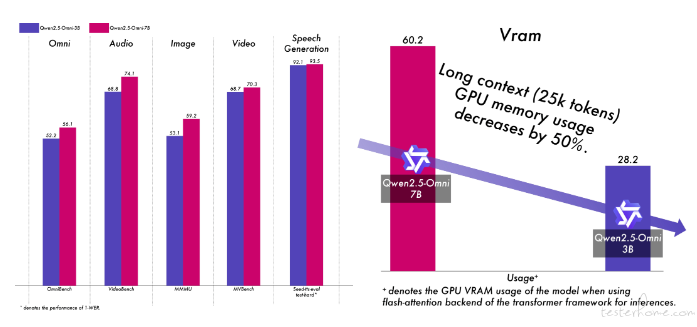

5、阿里通义发布小尺寸多模态模型:显存大大减少,语音输出自然度与稳定性媲美 7B 版本

(来源:Qwen@X)

阿里通义千问发布了新的小尺寸多模态模型「Qwen2.5-Omni-3B」,具体来看:

Qwen2.5-Omni-3B 为响应开发者轻量级 GPU 适配需求的新模型;

与 Qwen2.5-Omni-7B 相比 ,3B 版本在长上下文序列处理(约 25k tokens)中显存消耗减少超 50%,并可在普通 24GB 的消费级 GPU 上支持长达 30 秒的音视频交互 ;

3B 版本模型保留 7B 模型 90% 以上的多模态理解能力 ,语音输出自然度与稳定性与 7B 版本性能一致。

目前,Qwen2.5-Omni-3B 已在魔搭社区和 HuggingFace 上开源。(@APPSO)

02.有亮点的产品

1、AI Interviewer by Hyring:多语种 AI 面试产品

避免面试官疲劳造成错误判断:一致且专业的体验,提供公正的待遇和评估;

全面的主题覆盖:该 AI 涵盖以往的经验、技能、可用性和薪资;

动态和个性化的对话:该 AI 会根据每位候选人的回答不断调整,从而推动有见地的互动。

可以根据面试需要自行选择单向面试或双向互动面试。

支持多语种互动,目前包括英语、西班牙语、德语、俄罗斯语、韩语、法语等。

可以对面试者评分,包括技术评分、沟通评分、技能评级以及拟合分数,并出具面试者成绩单和面试情报。(@ProductHunt)

2、Lingloop:分析日常在线通话,评估英语水平并提供有针对性的反馈

Lingloop 会日常分析用户的会议、通话或练习,并提供个性化的反馈,帮助用户每天更自然地说英语 。

通过视频通话分析深入了解用户的英语水平,并追踪学习进度;

通过智能建议更正语法错误并扩展词汇量;

通过个性化练习和真实的对话反馈,专注于提升用户的薄弱点。(@ProductHunt)

03.有态度的观点

1、微软 AI CEO:AI 的个性与情商,与智商同等重要

日前,微软 AI CEO Mustafa Suleyman 接受了 AI Applied 的采访,前者在采访中畅谈了自己对 AI 未来发展的动向预测。

访谈一开始就谈及了 AI 未来发展的方向。Mustafa Suleyman 认为,AI 的发展过程中,个性、情商、语气等与智商同样重要。他强调,AI 不仅仅是工具,它们可以展现品牌的独特性,给用户带来更有情感共鸣的互动体验。

当前 AI 正在逐步融入情商特质,但仍需平衡情感和其他功能。同时,AI 也要跟人类现实生活一样,区分工作场景和个人生活两个不同领域的身份。Mustafa Suleyman 表示工作中使用的 AI 与家庭生活中的 AI 应该有所区别:

工作中的 AI 更偏向执行特定任务,语气中性;

生活中的 AI 则更具同理心,能够与用户建立深层次的关系,像个私人助手一样帮助管理日常事务。

另外,Mustafa Suleyman 还在访谈中指出了 AI 在沉浸、自然的发展中,应该拥有哪些细节。

他提到,语音交互是 AI 发展的关键,它不再只是一个工具,而是成为一种「数字物种」。AI 通过语音调整语调、语速等,能够展现其个性并与用户建立更深的联系。另外,AI 在语音交互中的微小细节(如停顿、语气)也是构建自然、沉浸的用户体验的必需要素。(@APPSO)

更多 Voice Agent 学习笔记:

级联 vs 端到端、全双工、轮次检测、方言语种、商业模式…语音 AI 开发者都在关心什么?丨 Voice Agent 学习笔记

a16z 最新报告:AI 数字人应用层即将爆发,或将孕育数十亿美金市场丨 Voice Agent 学习笔记

a16z 合伙人:语音交互将成为 AI 应用公司最强大的突破口之一,巨头们在 B2C 市场已落后太多丨 Voice Agent 学习笔记

ElevenLabs 33 亿美元估值的秘密:技术驱动 + 用户导向的「小熊软糖」团队丨 Voice Agent 学习笔记

端侧 AI 时代,每台家居设备都可以是一个 AI Agent 丨 Voice Agent 学习笔记

世界最炙手可热的语音 AI 公司,举办了一场全球黑客松,冠军作品你可能已经看过

对话 TalktoApps 创始人:Voice AI 提高了我五倍的生产力,语音输入是人机交互的未来

a16z 最新语音 AI 报告:语音将成为关键切入点,但非最终产品本身(含最新图谱)

写在最后:

我们欢迎更多的小伙伴参与 「RTE 开发者日报」 内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

素材来源官方媒体/网络新闻