【未来的思考】

1、chatGPT 会理解需求,会写代码,是不是会出现 IDE 只要贴需求,就自动写代码,通过 Copilot 诊断自优化,然后直接编译甚至部署一个应用?

2、同样基于第 1 点,chatGPT 会不会自己优化自己的源代码,自我进化再进化...

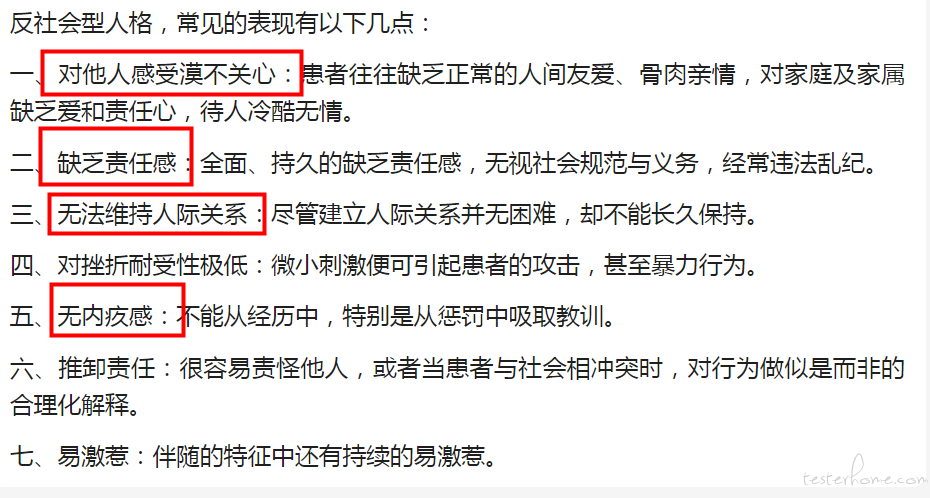

3、有报告说 chatGPT 有反社会人格的特征,我对比一下,,虽然没那么绝对,但也细思极恐:

【实际点的思考】

1、AI 生成的东西、做的东西我们是不是要完全信任?比如,我们信任的使用的软件(比如 office 相关),至少都是由人检测过的(白盒、黑盒、安全),那 AI 生成的呢?那是不是那些做逆向工程、安全的人的生存空间会好些.

2、chatGPT 目前能简化编码工作,可能会影响一些开发或编码性质的人的工作——测试方向主要是测试开发、自动化。如果软件的终端用户是人,人是软件优秀与否的最终评定者——传统的人工测试会不会依然有他的生存空间

3、生成的代码是不是可以无脑或者简单看下就直接使用?老话说 “尽信书不如无书”,是不是同样适用于这里:我们还需谨慎的使用这些 ai 提供的代码,那 “IT 知识(语言、框架、架构、中间件)” 依然需要好好学习和实践——知行合一才是 “道”

以上勿喷