一、核心痛点:自动化测试与测试管理「脱节」

很多团队已经在用自动化框架比如 TestNG 跑自动化测试,但执行结果停留在本地或者 CI 日志里,没有系统化沉淀到测试管理平台,导致:

- 结果不可见、难追溯

跑了 100 个用例,哪些通过、哪些失败、失败在哪些模块?只能看控制台或报告,难以在统一平台检索、筛选、对比。

跨版本、跨分支、跨环境的执行记录分散,无法系统化追溯某用例、某缺陷的历史表现。

问题:

某个用例 过去 6 个版本的通过率是多少?

某个模块 最近一个月失败最多的用例有哪些?

某个缺陷 是不是经常复现?

几乎很难回答。因为这些数据 没有被系统化记录。自动化测试每次运行完,就像一阵风吹过。

- 数据重复、人工成本高

用例要在测试管理系统里维护一份,代码/用例里又有一份,容易不同步。

执行结果、缺陷需要手动录入或复制,容易遗漏、延迟、出错。

测试计划、测试周期需要手工建立和关联,难以与真实执行一一对应。

问题:

用例代码改了,系统里的没改 或者 系统里的更新了,代码里的没更新

自动化执行的用例与管理系统里的用例 逐渐失去对应关系

- 质量视角受限

现有报表多聚焦「这一次运行」,难以从「开发 → 发布 → 维护」的全生命周期看质量趋势。 但软件质量其实需要看:

版本趋势

缺陷复现率

模块稳定性

无法把「用例执行结果」与「缺陷、版本、需求」系统化关联,做根因分析和趋势分析。

问题:

哪些用例 经常失败 ?

哪些模块 缺陷密度最高 ?

哪些缺陷 长期未修复 ?

没有结构化数据,这些问题很难分析

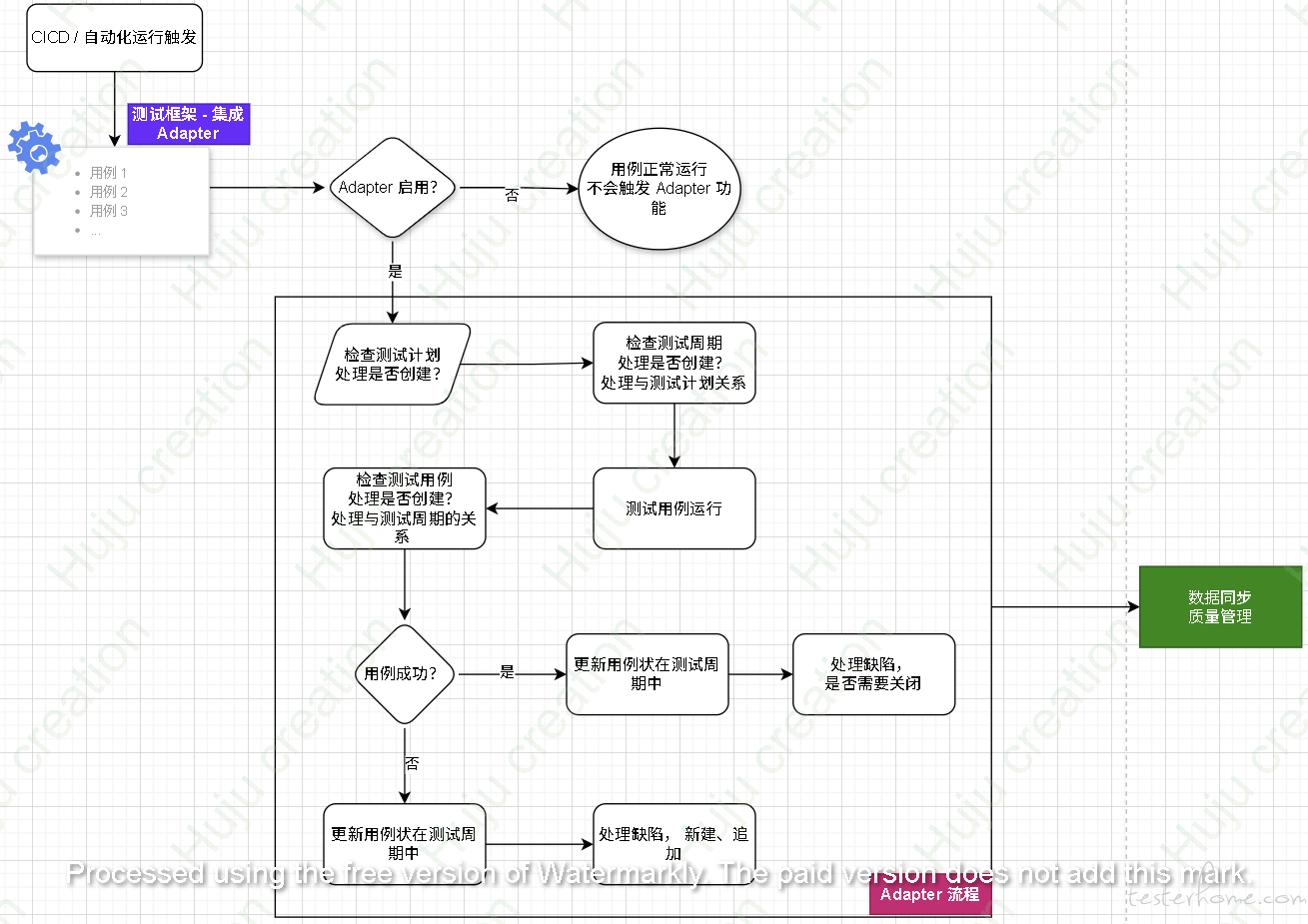

今天我介绍 一个 与我们系统集成在一起应用的 Adpater , 它的作用是 在测试框架 ↔ 优测系统之间提供一个自动同步通道,解决「自动化执行与测试管理、质量分析脱节」的痛点,把每次自动化测试的价值从「跑完就结束」变成「可沉淀、可追踪、可洞察」。

二、让自动化测试结果自动进入测试管理系统

支持的框架包括: TestNG , 当自动化测试运行时,Adapter 会自动完成几件事情。

自动同步测试结构

自动同步执行结果

自动创建或关联缺陷

让自动化数据真正沉淀下来

三、自动化测试真正的价值

当数据沉淀下来之后,就可以回答很多以前难以回答的问题:

例如:

哪些模块最不稳定?

哪些缺陷经常复现?

哪些用例通过率最低?

哪个版本质量最差?

测试不再只是:“跑用例” , 而是开始提供:“质量洞察”。

很多团队已经投入大量精力做自动化测试。但如果执行结果没有进入质量体系,自动化的价值就会被很大削弱。 我正在开发的系统,其中的 Adapter 组件,正是希望解决这个问题: 让自动化测试不只是 “跑完”, 而是变成可以沉淀、追踪、分析的质量数据。

如果你所在的团队也遇到类似问题,欢迎一起交流。

四、 如果有兴趣体验,可以留言或私信。

如果你的团队已经在使用 TestNG、Playwright 自动化框架,这个 Adapter 可以很接入现有流程。

目前正在寻找几个团队试用,有兴趣可以交流。