开发者朋友们大家好:

这里是 「RTE 开发者日报」 ,每天和大家一起看新闻、聊八卦。

我们的社区编辑团队会整理分享 RTE(Real-Time Engagement)领域内「有话题的新闻」、「有态度的观点」、「有意思的数据」、「有思考的文章」、「有看点的会议」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@SSN,@ 鲍勃

01 有话题的新闻

1、Kyutai 发布开源对话式 AI 助手 Moshi

法国人工智能实验室 Kyutai 发布了两个版本的人工智能助手 Moshi,能够与用户进行自然对话。在 7 月推出 AI 助手 Moshi 之后,Kyutai 现已按照承诺发布了开源模型。该版本包括几个组件:技术报告、Moshi 及其 Mimi 编解码器的权重以及 PyTorch、Rust 和 MLX 中的流式推理代码。

据报告称,Moshi 由三个主要组件组成:Helium,一个 7B 语言模型;Mimi,一个神经音频编解码器;以及一个新的多流架构。该系统可以对具有重叠和中断的实时对话进行建模。Kyutai Labs 提供了两个带有人工生成声音的 Moshi 模型。更多详细信息可在发表的论文和 GitHub 存储库中找到。

在演示中,Kyutai 首席执行官 Patrick Perez 解释说,Moshi 是由一个八人团队在短短六个月内开发的。Moshi 的与众不同之处在于它能够实时说话和聆听。Kyutai 声称 Moshi 的理论延迟仅为 160 毫秒,而实际上,延迟在 200 到 240 毫秒之间。

Moshi 的架构基于一种新方法,Kyutai 称之为「音频语言模型」。该模型不会像往常一样将语音转换为文本,而是对音频数据进行大量压缩并将其视为伪词。这使得它可以直接处理音频数据并预测语音,使其成为一个原生多模态模型,类似于 GPT-4o。

Kyutai 使用了各种数据源进行训练,包括人体运动数据和 YouTube 视频。首先,训练了一个名为 Helium 的纯文本模型。然后,使用文本和音频数据进行联合训练。使用合成对话对对话进行微调。

由于底层语言模型只有 70 亿个参数,因此它在对话中表现出小型模型的常见局限性。尽管如此,语言能力和速度令人印象深刻,并暗示了当这项技术采用更强大、更大的模块时,其潜力巨大。

为了让 Moshi 拥有一致的声音,Kyutai 与一位名叫 Alice 的配音演员合作。她录制了各种风格的独白和对话,然后用于训练语音合成系统。(@ 大模型 Daily)

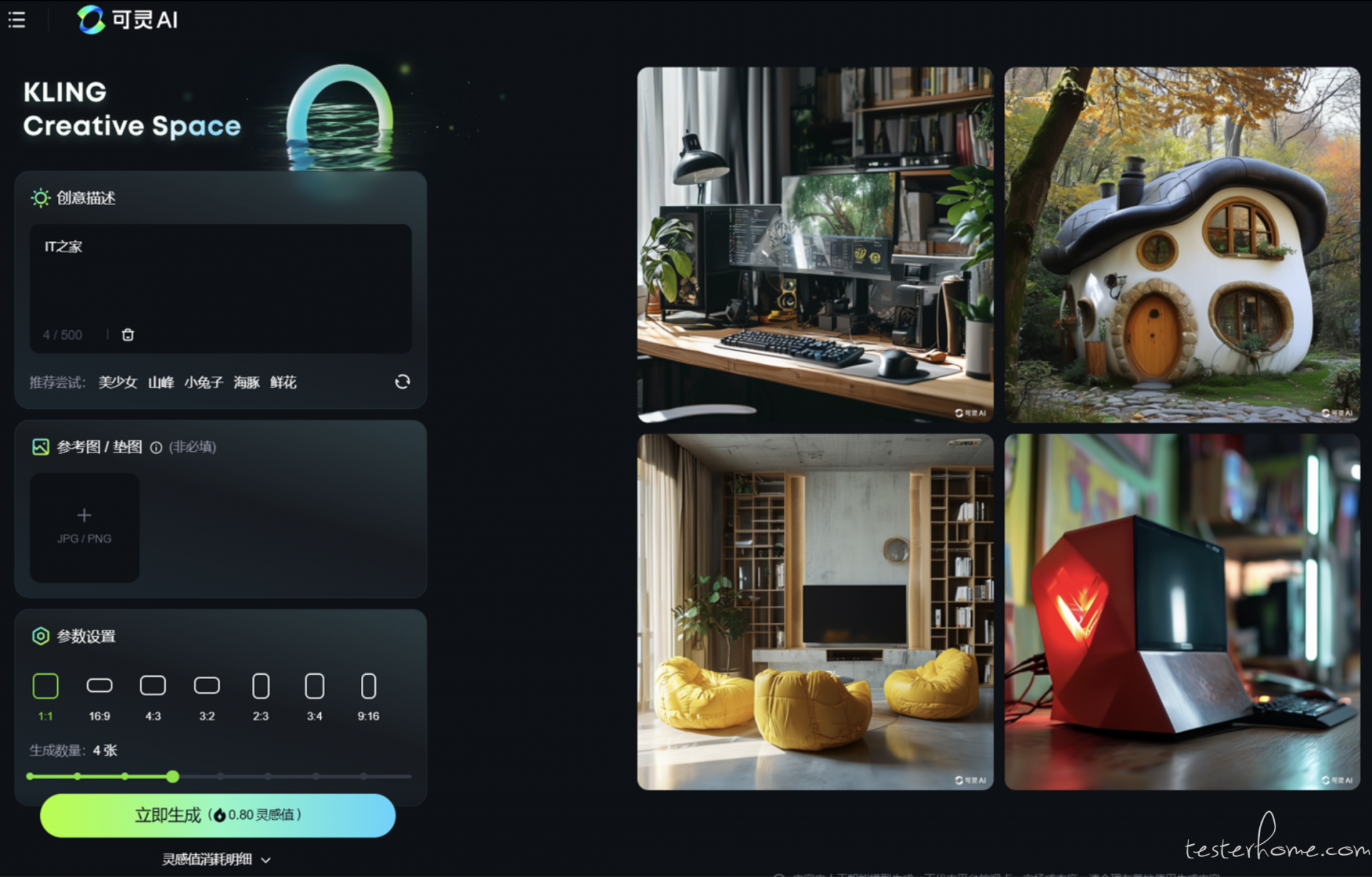

2、快手可灵 AI 发布 1.5 模型:新增「运动笔刷」,支持生成 1080p 视频

快手可灵 AI 今日面向全球发布可灵 1.5 模型,新增「运动笔刷」功能。据介绍,「运动笔刷」功能为图片中的元素(人或物体等)指定运动轨迹,还支持额外指定静止区域,提升画面可控性。

同时,可灵 AI 的视频画质有所提升,支持生成 1080p 视频,同时构图更美观、动作更合理、文本相关性提升。

快手高级副总裁盖坤 9 月 13 日在投资者日上披露,截至目前,已有超过 260 万人使用过快手的视频生成大模型可灵 AI,并累计生成超 2700 万个视频。产品发布以来,可灵 AI 已进行了 9 次迭代和升级,近期,可灵 AI 正在内测全新的 1.5 版本基础模型。

今年 8 月 23 日,快手可灵 AI 推出会员订阅计划,其中连续包月首月最低价 19 元、次月 58 元,可生成约 66 个视频或 3300 张图片,还可享受高表现视频生成、视频延长、大师运镜等多项会员专属功能。

据快手官方介绍,可灵大模型为快手 AI 团队自研,采用 Sora 相似的技术路线,结合多项自研技术创新、效果对标 Sora。快手可灵目前包括 AI 图片、AI 视频等功能,支持文字生成图片 / 视频,还能调节各项参数,免费用户使用会消耗「灵感值」,每日消耗完后便需付费使用。(@IT 之家)

3、AI 先驱李飞飞创业聚焦空间智能,要对整个世界建模

人工智能领域的知名华裔科学家李飞飞成立了 AI 公司「World Labs」,专注于空间智能技术的研究。李飞飞曾领导 ImageNet 项目,对深度学习算法发展有重要影响。World Labs 旨在开发能够理解 3D 世界并与之交互的 AI 模型,以支持创作、设计、学习、AR/VR 和机器人等领域的应用。公司已筹集超过 2.3 亿美元资金,预计 2025 年推出首款产品。李飞飞将这一创业视为自己职业生涯的延续和扩展。(@ 腾讯科技)

4、SiFive 推出 Intelligence XM 系列 RISC-V 架构 AI 数据流处理器

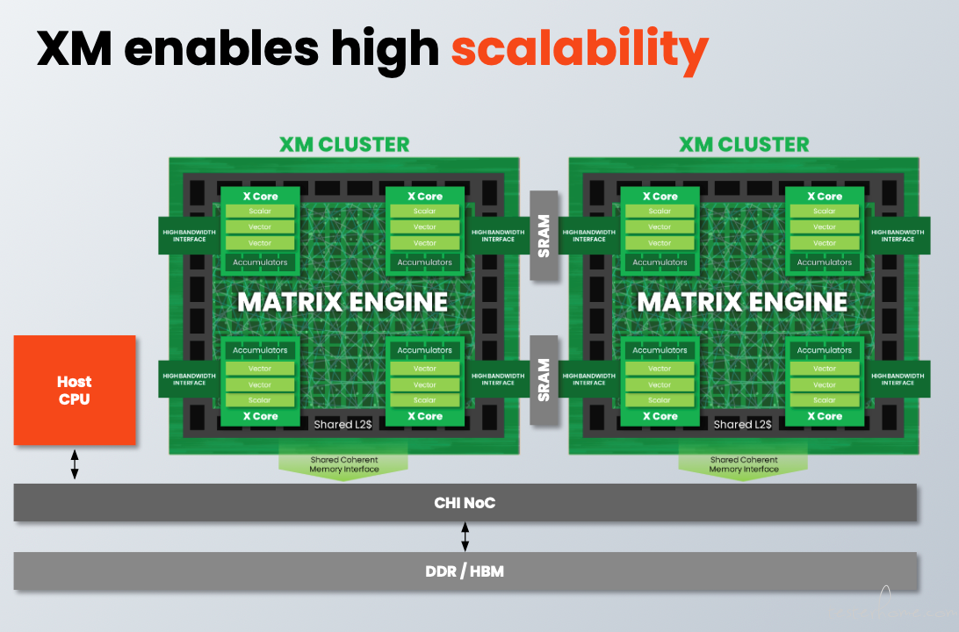

RISC-V 设计企业 SiFive 昨日宣布推出 Intelligence XM 系列 AI 数据流处理器。这一系列属于 SiFive 的 Intelligence 智能处理器 IP 核家族,该家族还包括 X390 等产品。

SiFive 表示 Intelligence XM 系列搭载同时具有扩展性和高效能的 AI 计算引擎,并延续了 SiFive IP 产品在计算密集型应用中优秀的每瓦性能表现。

SiFive Intelligence XM 系列的基本单元是 XM 集群,每个 XM 集群包含矩阵引擎和 4 个与之深度融合的 X-Core,而每个 X-Core 能提供 2 个矢量单元和 1 个标量单元。XM 集群支持新的矩阵指令,该指令由标量单元获取,源数据来自矢量寄存器,目的地为各个矩阵累加器。

SiFive 宣称 1 个 XM 集群每 GHz 频率可提供 16 TOPS INT8 算力或 8 TFLOPS BF16 算力,单 XM 集群持续带宽为 1TB/s。XM 集群拥有 2 种内存连接方式,一是直接通过高带宽接口访问存储模型数据的高速 SRAM,二是通过 CHI 接口访问 DDR、HBM 内存。

SiFive Intelligence XM 系列 AI 数据流处理器可通过 CHI 协议实现多 XM 集群扩展,其支持 RISC-V、x86 或 Arm 主机 CPU,也可无需主机 CPU 运行。(@IT 之家)

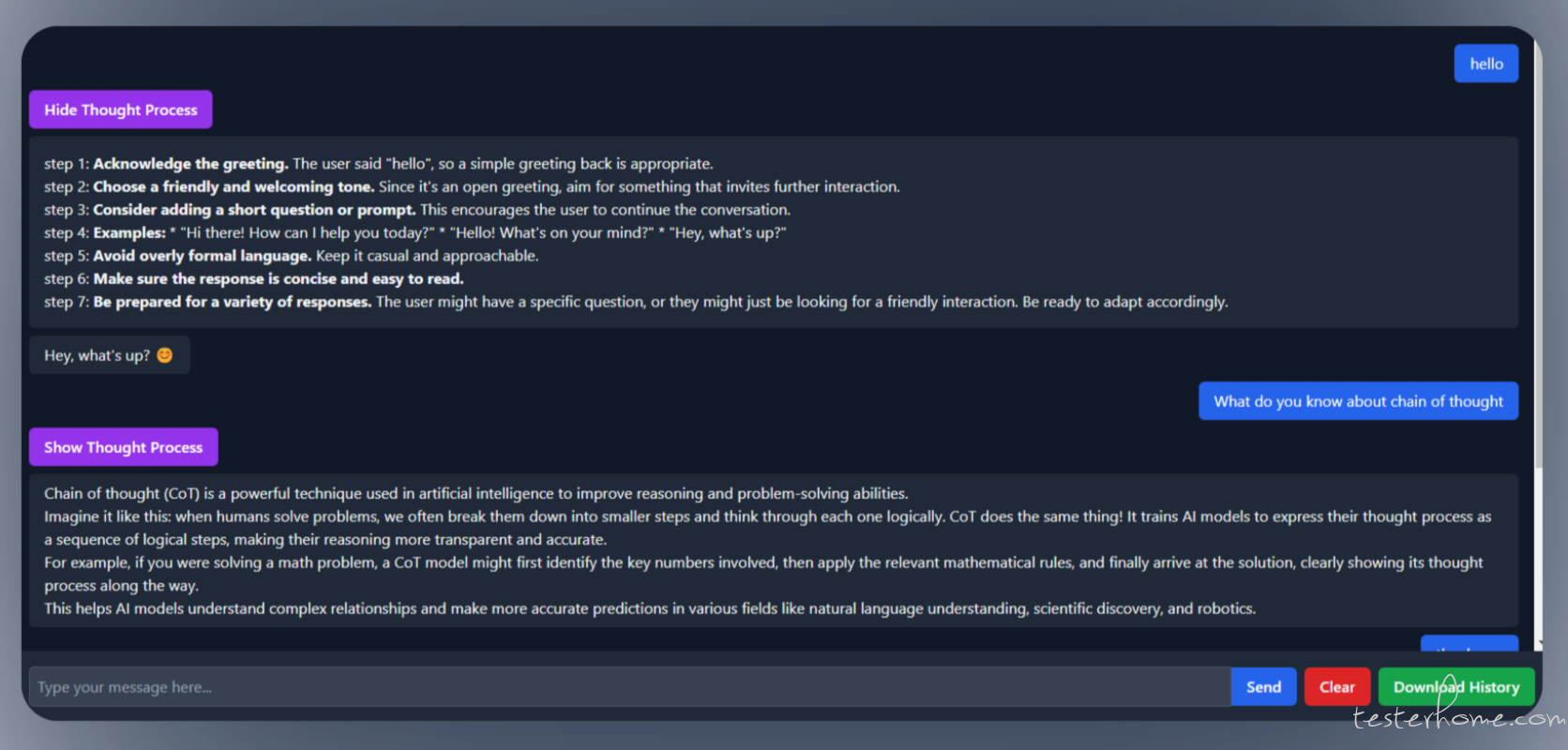

5、ReflectionAnyLLM

ReflectionAnyLLM 是一个轻量级的概念验证项目,旨在展示如何与任何支持 OpenAI 兼容 API 的大语言模型(LLM)进行基本的链式推理交互。该项目可以与本地或远程的 LLM 进行接口,允许用户在不同的提供商之间进行最小设置的切换。(@ 机器之心 SOTA 模型)

二、有态度的观点

1、Sam Altman 最新访谈:o1 相当于推理模型的 GPT-2

最近的 T-Mobile Capital Markets Day 活动上,OpenAI CEO Sam Altman 现身现场。他谈到了 o1 和 AI 的发展路径,以及 OpenAI 为何总能遥遥领先。

Altman 认为,o1 是第一个真正能够执行高级推理的系统,正处于推理模型的 GPT-2 阶段,未来几年发展到 GPT-4 的水平。o1 将带来新的模型使用方式,和 GPT 系列模型非常不同,它不仅仅是聊天界面。就像 ChatGPT 让 GPT-3.5 人尽皆知,o1 还需要时间磨合。o1 的出现,实现了 AI 发展阶段的跨越,带来了更加陡峭的进步曲线。OpenAI 的成功,是因为保持信念和专注,他们始终相信深度学习。Sam Altman 看好 AI 在医疗、教育、科学方面的进展,相信 AI 的发展能够带来真正可持续的经济增长与生活质量的改善。(@ APPSO)

写在最后:

我们欢迎更多的小伙伴参与「RTE 开发者日报」内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

素材来源官方媒体/网络新闻