经过差不多两年的研发,我们在 AI 大模型测试领域做了不少探索,在这里权当抛砖引玉,给大家分享一下我们平台建设的一点思路。

最初,我们的是为某个客户开发了一套可以在本地运行的 Python 程序的客户端,整个系统采用 CS 架构。前端用 Electron 实现封装,后端采用了 SpringBoot。

随着大模型的兴起,我们团队在意识到这个 Python 客户端也可以用来跑自动化测试,初步使用 browser-use 试验了一下,效果还很不错,于是我们正式立项,开发基于大模型的自动化测试平台。

平台起初的构想是使用 AI 生成测试用例,然后 AI 实现测试用例的自动评审,然后 AI 通过测试用例中的实施步骤,实现自主功能性测试。

整个项目依然采用了 CS 架构,为了尽快实现,我们采用了开源的 Metersphere 作为基础测试平台,在此基础上进行了开发。

实际上在我们加入 AI 之前,Metersphere 已经加入了一些基础的 AI 功能,我们在此基础上进行了增强。

目前我们支持 Word、PDF、Markdown、Axure、蓝湖等导出的 HTML 生成测试用例,但是实际生成的效果时好时坏。

后来我们意识到还是得优化提示词,但是客户的系统千差万别,很难提供一个统一的系统提示词,因此在此基础上,我们又开发了提示词管理功能:

提示词这里,我们有几个创新点,可以和大家分享一下:

第一个是我们首创了通过历史的需求文档和测试用例来反推提示词。

别说,这样一来效果还是非常惊人的。

测试生成的时候,我们采用了流式输出,效果还是很不错的 :)

另外,我们也针对不同的场景,提供了自定义提示词功能,比如从需求导入,到 AI 执行功能测试的时候的提示词都可以自定义。

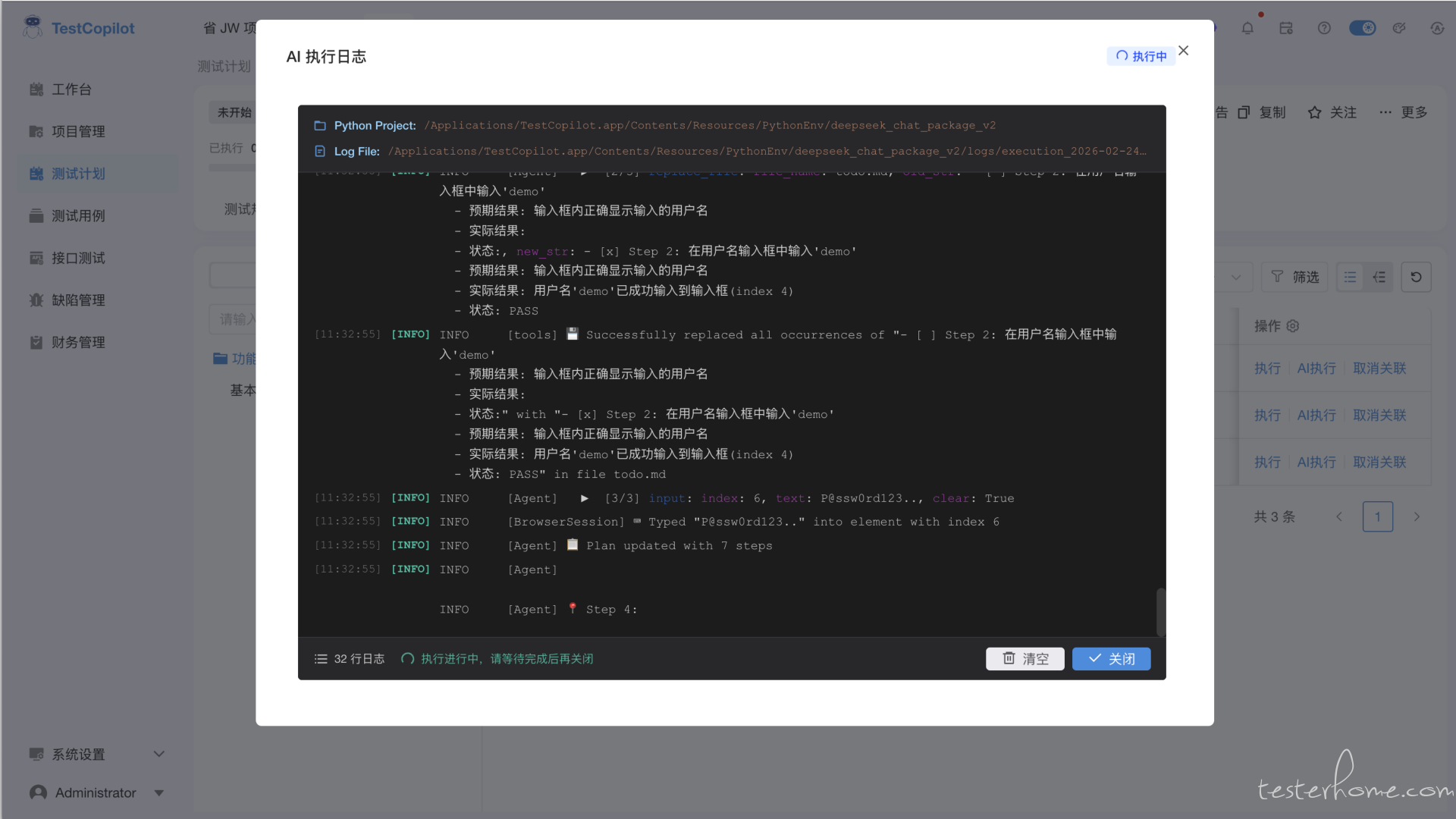

在使用 AI 执行浏览器自动化脚本的时候,我们也提供了丰富的日志信息,更牛的一点是,** 我们可以在 AI 执行自动化脚本的时候,自动收集当前页面的 API**,

这下可以让大家彻底的从接口测试里面解放出来。

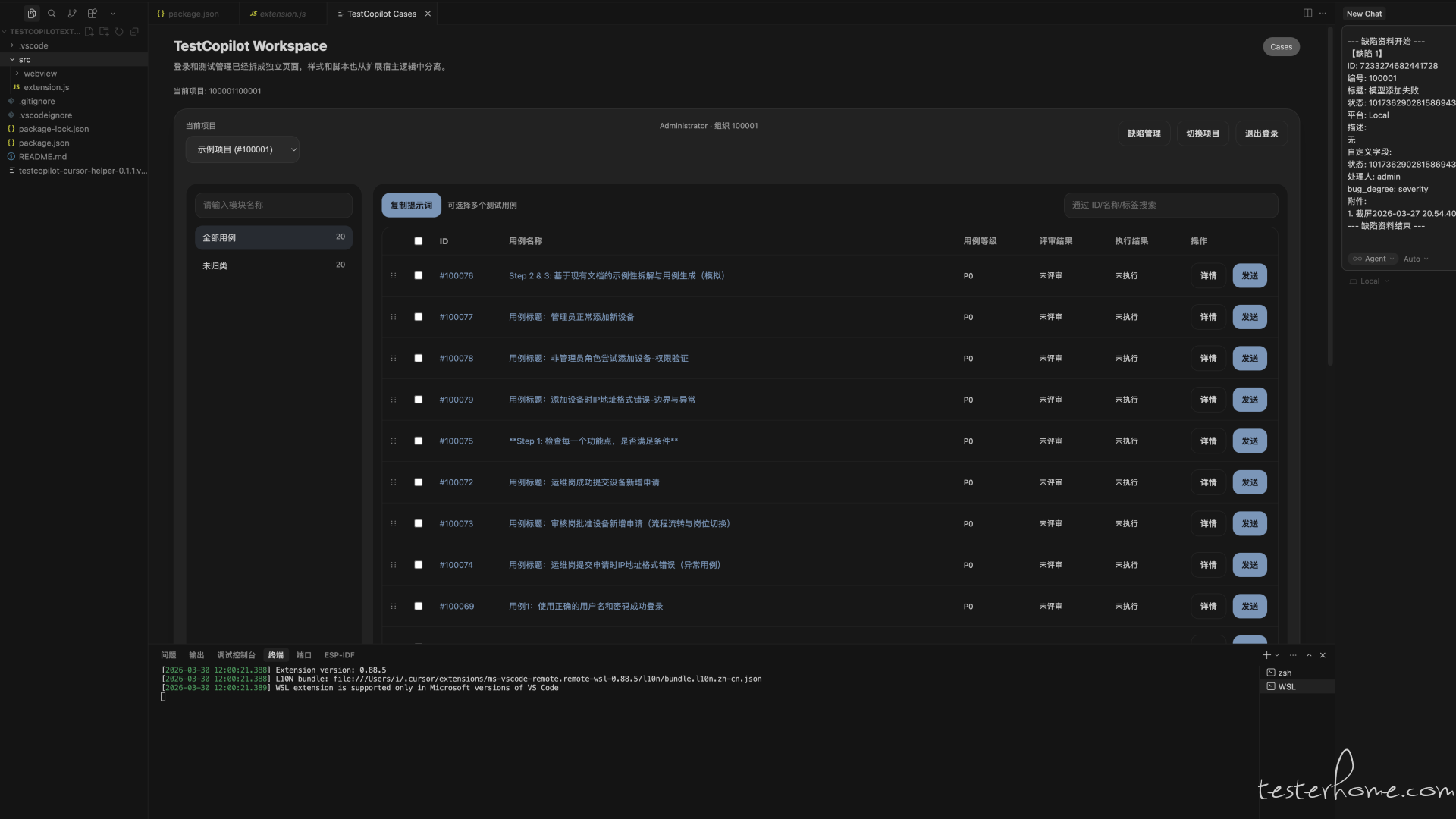

我们甚至还为开发人员,贴心的开发了一款 Cursor 插件,让大家可以在编程工具里面,直接调用我们的测试用例,生成代码。

以上是我们在 AI 测试方面的一些探索,有兴趣的朋友可以和我联系,我们一起改进产品。

另外产品是可以免费试用的哦,我们主要是针对 2B 客户的,也请 B 端的客户,和我们联系,共同推进 AI 大模型测试的进步。