开发者朋友们大家好:

这里是 「RTE 开发者日报」,每天和大家一起看新闻、聊八卦。我们的社区编辑团队会整理分享 RTE(Real-Time Engagement)领域内「有话题的 新闻 」、「有态度的 观点 」、「有意思的 数据 」、「有思考的 文章 」、「有看点的 会议 」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@SSN,@ 鲍勃

1、AutoGLM:国产 Agent 一句话控制手机电脑,打开了大模型 Act 时代

从 GPTs 到能够自主行动的 computer use,再到最近 AI 初创公司 /dev/agents 凭借 Agent 操作系统估值 5 亿美元,厂商们都在寻找 AI 下一个明确的落地方向。

今天上午,智谱 Agent 宣布升级,开放「百万内测」申请,翻开了人机交互体验的新一页。

这是智谱第一个产品化的智能体 Agent,可以做到让 AI 通过语音直接操纵硬件设备,还能跨不同 App 全局操作。

在发布会现场,智谱 CEO 张鹏展示了一番智能体的能力。让 Agent 与现场观众建面对面群聊,还发了一个总计两万块钱的红包。

智谱智能体的手机版 AutoGLM 与电脑版 GLM-PC,内测阶段覆盖部分常用的 App 及应用。

***AutoGLM:* 移动端(暂时向 Android 开放),可自主执行超 50 步的长步骤操作,适用于比价、导航、超话打卡等复杂操作

AutoGLM 支持包括微信、抖音、小红书、微博等社交平台、美团、饿了么、等美食平台、淘宝、京东、拼多多等购物平台、高德和百度地图等出行平台、以及 12306、去哪儿、携程等旅游订票平台。

用户打开 AutoGLM 后,只需要动动嘴(当然也支持文字输入),就能让智能体接管自己的手机,并在上面这些 App 上自动执行任何指令任务,比如在微信上对某个公众号的文章进行摘要总结、在高德地图上为你规划出行路线,等等。

AutoGLM-Web: 网页端,支持百度搜索、知乎、Github 等数十个网站的无人驾驶

AutoGLM 的自主执行能力还扩展到了网页端。智谱在浏览器(Google Chrome 和 Microsoft Edge)的智谱清言插件上提供了 AutoGLM-Web 功能。该功能适配了知乎、微博、X 和豆瓣等社媒网站,百度、谷歌和必应等搜索引擎,百度学术、谷歌学术和 arXiv 等学术网站,以及 GitHub 代码托管网站和资讯类网站。

在这些网站上,智能体遵循用户指令,可以自动执行站内搜索、内容总结、生成 arXiv 日报、搭建 GitHub 仓库、在微博超话签到等个性化功能,可玩性不错。如下所示,我们可以让它自动帮我们在微博分享新鲜事。

GLM-PC: PC 端(暂时向 Mac 系统开放),适用于解放打工人双手的生产力工具,手机也能远程操作电脑

在桌面端,智谱同样推出了像人一样操作计算机软件的应用 GLM-PC,它基于通用视觉大模型 CogAgent 的理解与任务规划能力,让用户通过简单的一句话指令执行复杂任务。比如查询并总结网页上的信息,并通过微信发送给别人。

不仅如此,智谱还实现了 GLM-PC 与手机端的联动。用户现在可以在手机上远程向 GLM-PC 发消息,让它自动进行电脑端操作。

最后,智谱在发布会现场表示,要对十个亿级 App 进行免费 Auto 升级。荣耀、华硕、小鹏汽车等大厂,高通、英特尔等硬件、芯片厂商也纷纷站台,介绍了与智谱的合作。(@ 机器之心)

2、马斯克 xAI 强势出击,Grok AI 有望下月推独立 App

据 The Verge 报道,xAI 正计划在 12 月为 Grok 推出一款独立应用,在扩大规模的过程中与 OpenAI 的 ChatGPT 正面交锋。

目前,付费用户可以通过 X 的网页或是 APP 来访问 Grok,而推出独立应用后,用户可以直接使用 Grok 的功能。此外,xAI 还为马斯克的另一家公司 SpaceX 旗下的 Starlink 提供客户支持功能。OpenAI 的 ChatGPT、谷歌的 Gemini 和 Anthropic 的 Claude 都已经有了自己的应用程序和免费产品,这使得 Grok 成为同类产品中的异类。(@ 极客公园)

3、亚马逊将推出新的 AI 视频模型

据 The Information 报道,亚马逊正在开发一款新的生成式人工智能,除了文本之外,还可以处理图像和视频内容,从而减少对人工智能初创公司 Anthropic 的依赖。

这款代号为 Olympus 的新型大型语言模型将能够理解图像和视频中的场景,并通过简单的文本提示帮助客户搜索特定场景。

新人工智能模型的开发将帮助亚马逊减少对 Anthropic 的 Claude 聊天机器人的依赖,后者是亚马逊网络服务(AWS)上的一款热门产品。

据知情人士透露,亚马逊可能最早于下周在 AWS 年度客户大会上宣布推出 Olympus。(@APPSO)

4、Kimi 联合清华大学共建大模型推理架构

11 月 28 日,Kimi 官方公众号发文,宣布联合清华大学等机构,开源共建大模型推理架构 Mooncake。

Kimi 官方表示,此次开源 Mooncake 架构,主要应对「如何应对高推理负载、降低推理成本、降低响应延迟」这一业界共同面临的难题。

Kimi 官方介绍,Mooncake 开源项目从论文延伸,以超大规模 KVCache 缓存池为中心,通过以存换算的创新理念大幅度减少算力开销,显著提升了推理吞吐量。本次开源将采用分阶段的方式,逐步开源高性能 KVCache 多级缓存 Mooncake Store 的实现,同时针对各类推理引擎和底层存储/传输资源进行兼容。

同时月之暗面 Kimi 工程副总裁许欣然表示:「Mooncake 不仅提升了 Kimi 的用户体验,降低了成本,还为处理长文本和高并发需求提供了有效的解决方案。」

2024 年 6 月,月之暗面 Kimi 和清华大学 MADSys 实验室联合发布了 Kimi 底层的 Mooncake 推理系统设计方案。该系统基于以 KVCache 为中心的 PD 分离和以存换算架构,大幅度提升了推理吞吐,受到业界广泛关注。(@APPSO)

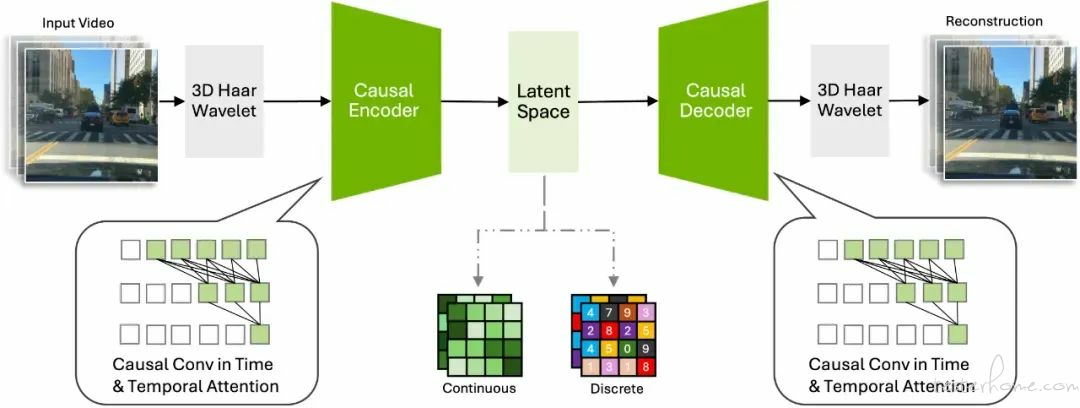

5、英伟达发布新的视觉压缩工具:Cosmos Tokenizer

最近,英伟达发布了新的视觉压缩工具——Cosmos Tokenizer,它能帮助我们在保持图像和视频高质量效果的同时实现显著的压缩率。

Cosmos Tokenizer 是一套用于图像和视频的神经 Tokenizer,旨在推进视觉 token 的技术前沿。

该项目支持大规模、稳健和高效的自动回归 transformer(如大型语言模型)或扩散生成器的开发。

项目提供了不同 tokenizer 的推理代码和预训练模型,能够实现高达 2048 倍的总压缩率,同时保持较高的图像质量,并比现有的最先进方法快 12 倍。

这款工具的特点在于它采用了统一的架构来处理图像和视频,而且支持连续型和离散型多种压缩方式。与现有技术相比,它的处理速度上提升了 2-12 倍,同时还保持了更小的模型体积。

在实际测试中,Cosmos Tokenizer 能够处理长达 8-10 秒的 1080p 高清视频,在各项基准测试中都优于现有方案。而且在视频质量评估上,它比现有技术提升了 4 分贝的峰值信噪比(PSNR),可以生成更清晰的画面效果。(@HsuDan)

1、Kimi 内测 AI 视频生成功能:每天免费 100 秒创作空间

人工智能聊天工具 Kimi 正在内测创新功能「Kimi 创作空间」,这一 AI 视频生成服务引发业界广泛关注。据报道,该功能目前处于灰度测试阶段。

据内部人士透露,「Kimi 创作空间」将在 Kimi 官网首页底部区域上线。用户可以通过 12 种预设风格模板和自定义创作功能,制作个性化音乐视频。更值得注意的是,用户每天将获得免费生成 100 秒视频的权限。

该功能不仅支持添加个性化音乐,还允许用户详细描述视频场景,为创意表达提供更多可能性。这一创新标志着 AI 视频生成技术在个人创作领域的又一重大突破。(@AIbase 基地)

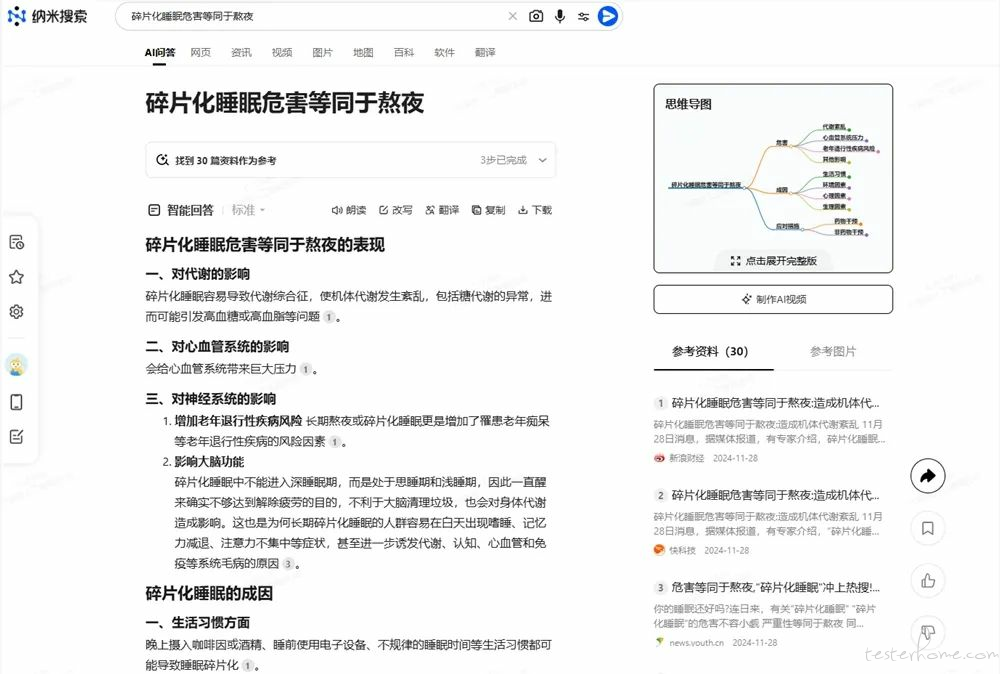

2、360 纳米搜索颠覆传统,支持一键生成脱口秀视频!

最近,360AI 搜索神器「纳米搜索」悄悄登陆 App Store 和应用宝,直接向百度、阿里夸克等老牌搜索巨头发起正面挑战。

为什么叫纳米搜索呢?据周鸿祎的说法,是希望做 AI 搜索能够从用户的实际需求出发,从细微之处着手,就像纳米一样,深入到每一个细节,真正帮用户解决问题。

纳米搜索并不是 360AI 搜索的简单升级版,它是一款全新的产品。它最大的特点在于对 AI 搜索流程的全面革新,将 AI 搜索与用户创作需求紧密结合,以「搜 - 学-写 - 创」四大功能模块,为用户提供一站式内容创作体验。

说的简单一些,就是让用户用 AI 搜索找到信息后,不用自己费劲巴拉地再去加工整理,直接就能生成各种想要的内容,比如视频脚本、脱口秀稿子等等。

在纳米搜索,你可以文字、语音、拍照、视频,多种搜索方式随心切换。无论是识人、识物、解题,还是规划旅游攻略,纳米搜索都能胜任。更惊人的是,它可以调用豆包、文心一言等 16 款大模型,并配备数十款智能工具。

而且,纳米搜索还支持将搜索的结果一键生成口播稿并生成视频。(@AIbase 基地)

3、瞄准 toB Agent!法国 AI 独角兽 H 推出首款产品 Runner H,专注企业自动化与定制化场景

去年夏天,法国 AI 初创公司 H 在尚未发布任何产品的情况下,宣布完成了惊人的 2.2 亿美元种子轮融资,引发行业轰动。

近日,H 正式发布首款产品 Runner H,以及用于构建自动化解决方案的 Studio 平台,标志着企业自动化和开发者工具的重大进步。

这款智能体化的产品瞄准企业客户和开发者,主打质量保障、流程自动化等场景,基于该公司自研的紧凑型大语言模型,拥有仅 20 亿参数。

CEO Charles Kantor 表示,公司正在进行 A 轮融资,以支撑他所称的「AI 第二阶段」。与 OpenAI 等「第一阶段」公司主攻通用模型不同,H 专注于特定任务和场景,提供定制化解决方案。

Runner H 专注三大应用场景

目前,H 已经悄悄与多个领域的客户合作,包括电商、银行、保险和外包服务,通过真实反馈不断优化产品。

聚焦以下三个核心场景:

1)机器人流程自动化(RPA)

RPA 是一种成熟但尚未充分结合 AI 的技术,常用于自动化处理表单、勾选框以及文件传输等重复性任务。Runner H 的优势在于,即便处理的模板有所修改,其 AI 仍可运行无误,支持更广泛的数据源。

2)质量保障(QA)

在质量保障方面,Runner H 擅长减轻网站测试等复杂任务的「维护负担」,例如验证页面可用性、模拟真实用户行为,以及确保支付方式的兼容性,尤其是在网站被修改后。

3)业务流程外包(BPO)

BPO 涵盖从改进账单处理流程到加速数据访问和使用的多种任务。Runner H 能够提升企业操作效率,为客户节省时间和成本。(@ 有新 Newin)

1、清华大学教授:AI 可能会出现自我意识的觉醒

近期,清华大学教授刘嘉接受了腾讯研究院的「AI&Society 百人百问」研讨,并且表示「AI 可能会出现自我意识的觉醒」。

刘嘉教授认为,AI 可能会出现自我意识的觉醒。其中刘嘉教授提到「当大模型有意识或者有情感、有创造力的时候,它就不再是一个工具,它会是一个全新物种」,因此他认为「除了要继续推动 AI 发展,还需要建立一套 AI 伦理学。甚至要放弃完全以人为中心的这种视角,去看未来的混合社会」。

刘嘉教授提到,「大模型从一开始来讲,就是创造,要具有创造力,能够产生新的事物。从这个角度来看,大模型它不是一种机械的基于统计的这种重复,而是开始有它自己独立的思想,有它独立的推理,它一定会有创造力。」

同时刘嘉教授表示,因为大模型的训练语料来自对人类知识的预训练,所以大模型要取代或者影响最大的行业一定是知识密集型行业。(@APPSO)

写在最后:

我们欢迎更多的小伙伴参与「RTE 开发者日报」内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

素材来源官方媒体/网络新闻