开发者朋友们大家好:

这里是 「RTE 开发者日报」 ,每天和大家一起看新闻、聊八卦。我们的社区编辑团队会整理分享 RTE(Real-Time Engagement)领域内「有话题的新闻」、「有态度的观点」、「有意思的数据」、「有思考的文章」、「有看点的会议」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@SSN,@ 鲍勃

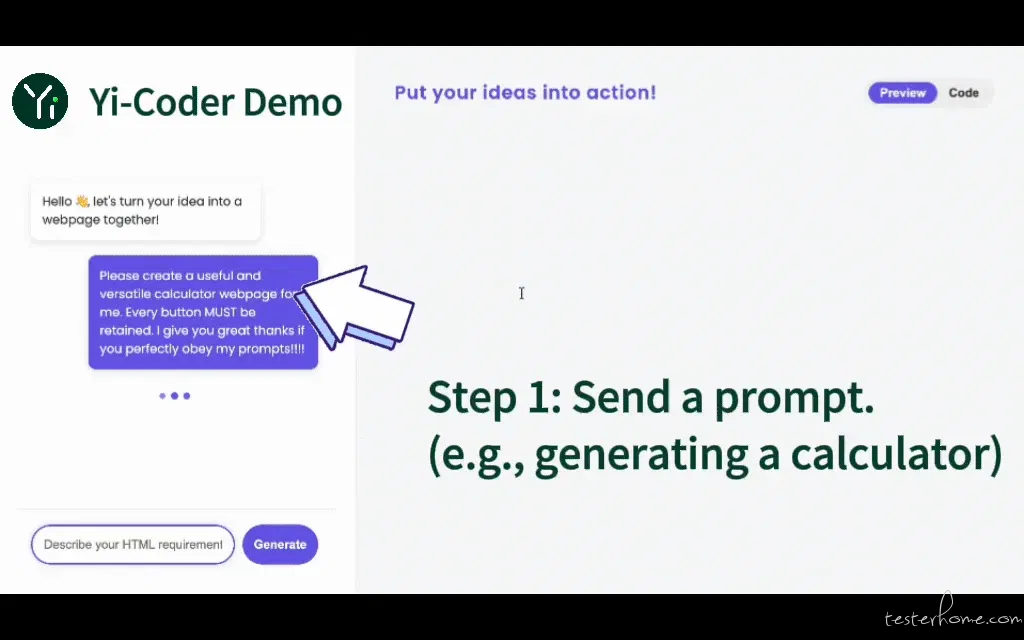

1、零一万物开源 Yi-Coder 系列编程助手模型,支持 52 种编程语言

零一万物今日宣布开源 Yi-Coder 系列模型,该模型是 Yi 系列模型家族中的编程助手。

Yi-Coder 系列模型专为编码任务而生,提供 1.5B 和 9B 两种参数。其中,Yi-Coder-9B 的表现号称「优于其他 10B 参数以下的模型」,如 CodeQwen1.5 7B 和 CodeGeex4 9B,甚至能够「与 DeepSeek-Coder 33B 相媲美」。

据介绍,Yi-Coder 能够处理最长 128K tokens 的上下文内容,适用于复杂项目级代码的理解和生成。Yi-Coder 还支持 52 种主要编程语言。

根据零一万物官方测试,Yi-Coder-9B-Chat 在 HumanEval 和 MBPP 的通过率分别达到了 85.4% 和 73.8%。此外,Yi-Coder 9B 在 CRUXEval-O 的准确率在开源 Coder 模型中首次达到了 50% 以上。(@IT 之家)

2、原 OpenAI 首席科学家 Ilya Sutskever 新公司 SSI 融资 10 亿美元,估值 50 亿

路透社报道称 OpenAI 前首席科学家 Ilya Sutskever 所创办的人工智能初创公司 SSI 宣布获得 10 亿美元的投资。将用于开发安全的超级智能,消息人士称其估值为 50 亿美元。而这距离 Ilya 6 月 20 日在社交平台 X 上发文宣布成立 SSI(safe superintelligence,安全超级智能)不到 3 个月,AI 情报局曾报道安全超级智能公司 SSI 的唯一目标是开发安全的超级智能,在实现这一目标之前不会发布其他产品。SSI 现拥有 10 名员工,该公司计划利用这些资金聘请更多顶级人才并购买硬件设备。公司将组建一支由专业研究人员和工程师组成的小规模,但值得高度信任的团队。

投资者包括顶级风投公司 Andreessen Horowitz、Sequoia Capital、DST Global 和 SV Angel。此外,由 Nat Friedman 和 SSI 首席执行官 Daniel Gross 运营的合伙企业 NFDG 也参与其中。(@ 雷锋网)

3、万人测试 OpenAI 搜索引擎:活动规划等表现出色,存在「幻觉」等不足

根据报道,从初期 1 万名用户反馈来看,被很多人视为「谷歌杀手」、来自 OpenAI 的 SearchGPT 搜索引擎虽然有很多亮点功能,但要撼动谷歌搜索地位仍有很长的路要走。

部分功能非常优秀

SearchGPT 并非通过搜索结果列表,而是通过提供简洁、有条理的回答,简化用户的搜索体验。

SearchGPT 利用必应和其他来源的数据编制答案,OpenAI 将其视为用户搜索信息的综合资源。

SearchGPT 初期用户反馈褒贬不一,在规划活动、编程、总结信息等特定查询方面,SearchGPT 表现比较优秀。

不足之处

软件工程师 Ananay Arora 认为, SearchGPT

现阶段不会对谷歌造成威胁,其在搜索本地餐馆方面表现出色,但搜索图片结果比较糟糕,且来源的标注方式会让人困惑。

技术专家 Daniel Lemire 认为它优于谷歌的 AI Overviews ,但不如 Perplexity 令人印象深刻。

人工智能爱好者 Matt Berman 在 YouTube 上发布视频,表示 SearchGPT

在活动策划、编程方面上的表现优于谷歌,但存在「幻觉」问题,给出的演讲者信息并不正确

搜索营销公司 BrightEdge 发现,尽管 SearchGPT

具有创新功能,但它仍然落后于谷歌,尤其是在网上购物和本地搜索等任务方面。(@IT 之家)

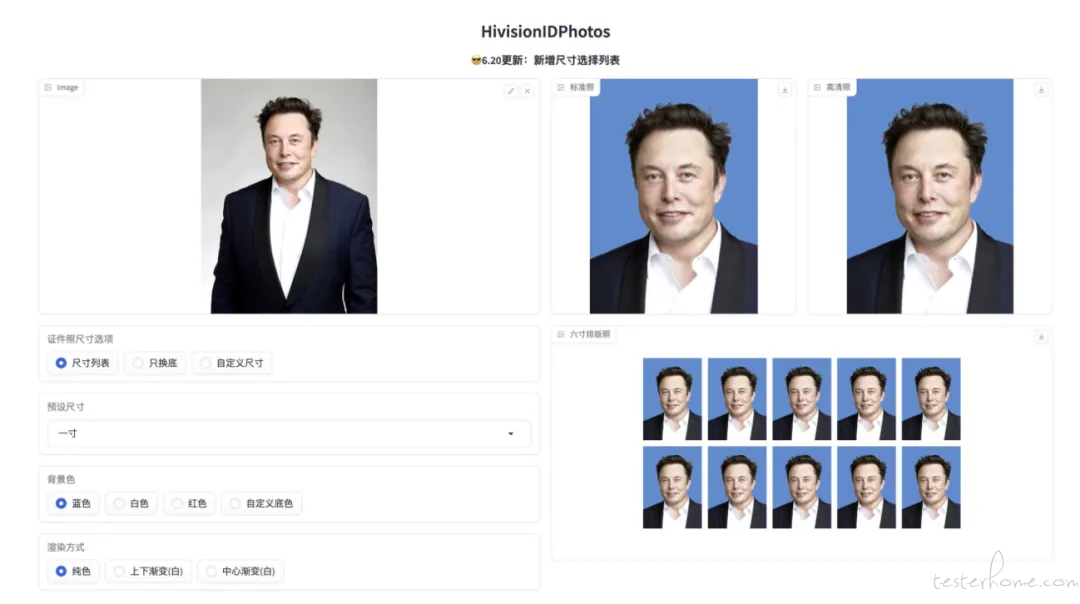

4、HivisionIDPhotos :轻量级且高效的 AI 证件照制作工具 可以生成各种标准证件照

HivisionIDPhotos 是一个轻量级且高效的 AI 证件照制作工具,旨在为用户提供便捷的证件照生成方案。该项目通过 AI 算法实现对多种用户拍照场景的识别、抠图以及证件照生成,能够根据不同尺寸规格生成标准证件照和排版照,未来还计划添加美颜和智能换正装功能。该工具目前在 GitHub 获得了 3K+ 星标。

HivisionIDPhoto 支持:

轻量级抠图: 利用高效的 AI 算法,HivisionIDPhoto

能够精确地从照片中抠取人像,生成干净的透明背景图像,为后续处理提供高质量的素材。

生成标准证件照: HivisionIDPhoto

支持根据不同的规格要求生成标准证件照,适用于各种用途,如护照、签证等。用户可以指定尺寸,并根据需要调整背景颜色和其他参数。

生成六寸排版照: 该工具可以将多张证件照排版成标准的六寸照片,方便用户进行打印和批量制作。

智能换背景: HivisionIDPhoto

支持为证件照增加或更换背景颜色,用户可以轻松选择符合要求的背景色,从而快速完成证件照的制作。(@ 小互 AI)

5、Altera.AI 创造首个智能体文明 Project Sid

Altera.AI 在《我的世界》游戏中创造了全球首个智能体文明,项目代号为 Project Sid。该文明由 1000 多个自主智能体组成,它们在游戏中模拟了人类社会的多个方面。这些智能体能够进行自然语言交流,通过游戏内的聊天系统进行对话,展现出独特的个性和记忆。

Altera.AI 是一家应用研究实验室,正在开发其首批游戏产品。该公司 CEO Robert Yang 曾是 MIT BCS 和 EECS 教授、MIT MetaConscious 小组负责人,2023 年 12 月辞去了 MIT 的终身教职,创办该公司。Altera.AI 曾获 Andreessen Horowitz 领投的 200 万美元的 Pre-Seed 轮融资。后来又筹集了 900 万美元的种子轮融资,领投方包括谷歌前 CEO Eric Schmidt 的 First Spark Ventures、Patron VC 和 Mitch Lasky、Bob Meese、Stephen Lim 等。(@ 雷锋网)

1、最新研究:反复使用 AI 生成的内容来训练 AI 可造成「模型崩溃」

据《福布斯》报道,牛津大学的伊利亚・舒梅洛夫博士和他的团队发现,当生成式 AI 软件仅依赖于由 AI 生成的内容时,回答的质量开始恶化。这项研究已经发表在《自然》杂志上。

「在最初的两次查询后,答案逐渐偏离准确性,到第五次时,质量显著下降,到了第九次连续查询时,回答已完全退化为无意义的胡言乱语。」研究人员将这种生成式 AI 内容的循环过度使用称为「模型崩溃」,即 AI 在不断污染自己的训练集后,输出的内容逐渐偏离现实,最终变得毫无价值。

研究人员通过一种方法确定了「模型崩溃」现象的存在:使用一个预训练的 AI 驱动的维基百科,然后让 AI 模型基于自己生成的内容进行更新。受污染数据的影响逐渐导致原本的训练集被侵蚀,输出的信息也随之变得难以理解。例如,在第九次查询循环后,研究中的维基百科条目从关于 14 世纪英国教堂尖顶的内容滑稽地变成了一篇关于各种颜色的短尾兔子的论文。

报道称,根据亚马逊网络服务(Amazon Web Services)团队在 6 月发布的另一项研究,大约 57% 的网络文本都经过了 AI 算法的翻译。如果互联网上的人类生成数据迅速被 AI 过滤内容覆盖,且舒梅洛夫的研究发现属实,那么 AI 可能正在「自我毁灭」—— 并同时「毁灭」互联网。

研究得出结论,要实现 AI 的长期可持续发展,唯一方法是确保其能够访问现有的非 AI 生成内容,并持续引入新的人工生成内容。(@IT 之家)

写在最后:

我们欢迎更多的小伙伴参与「RTE 开发者日报」内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

素材来源官方媒体/网络新闻